A inteligência artificial deixou de ser uma tecnologia futurista para se tornar parte essencial das operações empresariais no mundo inteiro. Mas essa transformação trouxe desafios complexos. Empresas que desenvolvem sistemas de inteligência artificial sem frameworks robustos de governança enfrentam riscos sem precedentes.

O cenário mudou dramaticamente nos últimos anos. A ética em inteligência artificial não é mais um tema filosófico restrito a universidades. Ela se transformou em uma matriz de risco corporativo fundamental. Organizações que ignoram princípios éticos em seus sistemas enfrentam multas severas e perdem a confiança de usuários e investidores.

Este guia completo explora como implementar governança ética robusta em projetos de inteligência artificial. Você descobrirá frameworks práticos, estratégias de mitigação de riscos e formas de construir sistemas que respeitam valores fundamentais de justiça e transparência.

A Transformação da Ética em Requisito Corporativo Obrigatório

Durante décadas, a ética corporativa foi considerada um diferencial competitivo opcional. As empresas podiam escolher se investiriam em práticas responsáveis. Essa realidade mudou completamente com a proliferação de sistemas baseados em inteligência artificial.

Hoje, reguladores em diversos países estabeleceram normas rigorosas. A União Europeia implementou o AI Act, legislação que classifica sistemas de inteligência artificial por nível de risco. O Brasil avança com discussões sobre regulamentação específica, complementando a Lei Geral de Proteção de Dados.

Mudança de Paradigma nos Negócios

As organizações enfrentam uma mudança fundamental na forma como conduzem desenvolvimento tecnológico. Investidores agora exigem transparência sobre como a inteligência artificial é utilizada. Conselhos administrativos questionam executivos sobre potenciais riscos éticos em suas operações.

Essa transformação reflete uma consciência crescente. Usuários finais tornaram-se mais educados sobre os riscos do uso indevido de dados pessoais. Funcionários questionam se as ferramentas que utilizam diariamente respeitam princípios responsáveis. Parceiros comerciais avaliam se suas cadeias de suprimento adotam práticas éticas.

Pressão Regulatória Global

Governos ao redor do mundo estabeleceram agências especializadas. Essas entidades monitoram como organizações desenvolvem e implantam tecnologia baseada em inteligência artificial. As penalidades por violações cresceram exponencialmente.

Regulamentação Europeia

A União Europeia estabeleceu padrões rigorosos com o AI Act, classificando sistemas por risco e estabelecendo obrigações específicas para cada categoria.

- Proibição de sistemas de risco inaceitável

- Requisitos estritos para sistemas de alto risco

- Transparência obrigatória para chatbots

- Multas de até 6% da receita global

Cenário Brasileiro

O Brasil fortalece sua estrutura regulatória através da LGPD e discussões sobre legislação específica para inteligência artificial.

- ANPD monitora tratamento de dados em IA

- Projeto de lei sobre IA em tramitação

- Setores regulados com normas adicionais

- Crescente jurisprudência sobre algoritmos

Padrões Norte-Americanos

Estados Unidos adotam abordagem descentralizada, com estados criando legislações específicas e agências federais estabelecendo diretrizes setoriais.

- Legislações estaduais em expansão

- Diretrizes da FTC sobre práticas enganosas

- Regulação setorial em saúde e finanças

- Crescente fiscalização de viés algorítmico

Iniciativas Asiáticas

Países asiáticos desenvolvem abordagens próprias, equilibrando inovação tecnológica com proteção de direitos fundamentais.

- China estabelece regulações sobre algoritmos

- Japão foca em princípios orientadores

- Coreia do Sul investe em IA confiável

- Singapura adota framework voluntário

Impacto no Mercado Financeiro

Investidores institucionais incorporaram critérios ESG em suas análises. A governança em inteligência artificial tornou-se componente essencial dessas avaliações. Empresas com práticas questionáveis enfrentam dificuldade para atrair capital.

Fundos de investimento desenvolveram metodologias específicas para avaliar riscos associados à inteligência artificial. Eles analisam se organizações possuem comitês de ética, processos de auditoria independente e mecanismos de responsabilização claros.

Avalie o Nível de Maturidade da sua Governança em IA

Baixe nosso Framework de Avaliação de Governança em IA Responsável e identifique lacunas críticas de compliance em apenas 15 minutos. Ferramenta utilizada por líderes em diversos setores.

Riscos Críticos da Ausência de Frameworks de Transparência em IA

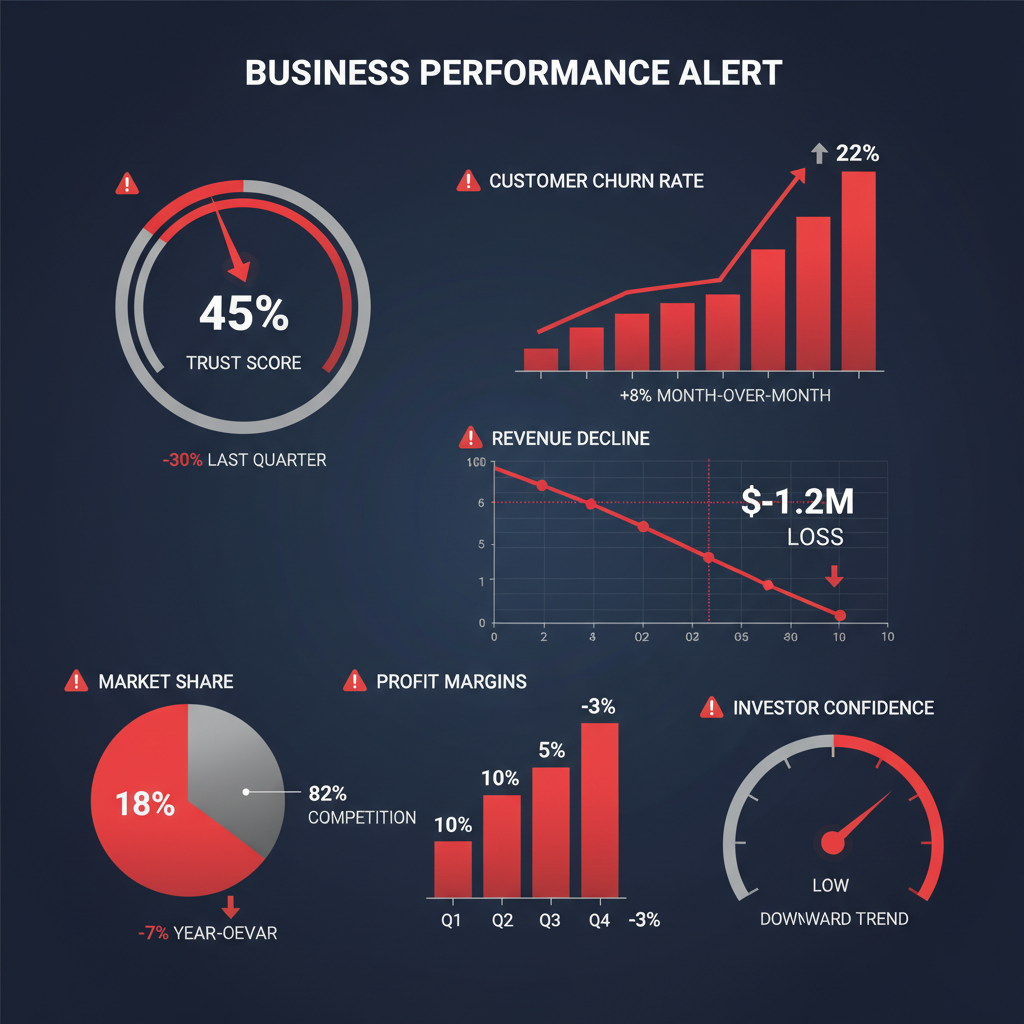

Organizações que operam sistemas de inteligência artificial sem estruturas adequadas de governança expõem-se a múltiplos vetores de risco. Esses perigos vão muito além de questões técnicas, afetando a própria viabilidade do negócio no meio do mercado competitivo atual.

Risco Regulatório e Compliance

A ausência de transparência em sistemas de inteligência artificial coloca empresas em rota de colisão com reguladores. Autoridades de proteção de dados exigem explicabilidade sobre como algoritmos processam informações pessoais. Organizações incapazes de demonstrar conformidade enfrentam investigações demoradas.

O problema se agrava quando empresas operam em múltiplas jurisdições. Cada região possui requisitos específicos de governança. A falta de um framework unificado cria lacunas de compliance que expõem a organização a penalidades em diversos mercados simultaneamente.

Risco Reputacional e Perda de Mercado

Incidentes envolvendo uso indevido de inteligência artificial ganham repercussão imediata nas redes sociais. Uma única decisão algorítmica discriminatória pode gerar crise reputacional devastadora. A recuperação da confiança de usuários e do público em geral demanda anos de trabalho consistente.

Clientes tornaram-se mais exigentes sobre como suas informações são utilizadas. Pesquisas indicam que consumidores abandonam marcas que demonstram práticas questionáveis no tratamento de dados pessoais. Essa tendência é especialmente forte entre gerações mais jovens.

Dado Relevante: Estudos recentes demonstram que 78% dos consumidores brasileiros evitam empresas com histórico de má gestão de dados pessoais. A perda de confiança traduz-se diretamente em queda de receita e participação de mercado.

Risco Operacional e Decisões Enviesadas

Sistemas de inteligência artificial sem supervisão adequada perpetuam e amplificam vieses existentes em dados de treinamento. Algoritmos de recrutamento discriminam candidatos qualificados. Modelos de crédito negam financiamentos baseados em correlações espúrias. Ferramentas de diagnóstico médico falham com pacientes de determinados grupos demográficos.

Essas falhas operacionais custam caro às empresas. Processos de contratação enviesados resultam em equipes menos diversas e menos inovadoras. Decisões de crédito discriminatórias levam a ações judiciais coletivas. Erros em sistemas de saúde causam danos diretos a pessoas e geram responsabilidade legal massiva.

Risco Jurídico e Litígios

O ambiente jurídico evolui rapidamente. Tribunais ao redor do mundo começam a responsabilizar empresas por decisões automatizadas que causam prejuízos. A jurisprudência estabelece precedentes sobre o dever de cuidado no desenvolvimento de sistemas inteligentes.

Benefícios de Frameworks Robustos

- Proteção legal contra litígios de discriminação

- Demonstração de boa-fé regulatória

- Redução de custos com investigações

- Fortalecimento de posição em negociações

- Atração de talentos éticos

- Acesso a mercados regulados

Consequências da Ausência

- Exposição a ações judiciais coletivas

- Investigações regulatórias prolongadas

- Custos elevados de remediação

- Perda de licenças operacionais

- Dificuldade em recrutar profissionais

- Exclusão de oportunidades de negócio

Risco Competitivo e Inovação

Empresas que constroem reputação sólida em governança ética ganham vantagem competitiva significativa. Elas atraem os melhores talentos em tecnologia e ciência de dados. Profissionais qualificados preferem trabalhar em organizações que valorizam princípios responsáveis.

A ausência de frameworks também limita oportunidades de parcerias estratégicas. Grandes corporações estabeleceram políticas rigorosas de due diligence para fornecedores. Empresas sem governança adequada são excluídas de concorrências e processos de seleção.

Risco de Segurança e Ataques Adversariais

Sistemas de inteligência artificial sem governança adequada são mais vulneráveis a ataques. Hackers desenvolvem técnicas sofisticadas para manipular modelos de machine learning. A falta de monitoramento contínuo permite que essas manipulações passem despercebidas até causarem danos significativos.

A segurança em inteligência artificial requer abordagem holística que combine proteção técnica com supervisão humana. Organizações sem frameworks estabelecidos carecem dos processos necessários para detectar e responder a ameaças emergentes.

Consequências Devastadoras da Ausência de Mitigação de Viés Algorítmico

O viés algorítmico representa uma das ameaças mais insidiosas em sistemas de inteligência artificial. Diferentemente de falhas técnicas óbvias, esses vieses operam de maneira sutil, perpetuando e amplificando discriminações históricas que existem nos dados de treinamento utilizados no desenvolvimento de modelos.

Perpetuação de Desigualdades Históricas

Algoritmos treinados em dados históricos inevitavelmente absorvem preconceitos embutidos nesses registros. Se um setor tinha práticas discriminatórias no passado, um sistema que aprende desses dados replicará essas injustiças em escala massiva. A inteligência artificial transforma discriminações individuais em discriminação sistemática automatizada.

O problema é particularmente grave em contextos socialmente sensíveis. Sistemas de justiça criminal que recomendam sentenças baseadas em dados históricos discriminam contra grupos minoritários. Algoritmos de seleção para programas sociais negam benefícios a pessoas que mais precisam devido a correlações espúrias em informações de base.

Impacto Desproporcional em Grupos Vulneráveis

Comunidades historicamente marginalizadas sofrem de forma desproporcional com viés algorítmico. Mulheres enfrentam discriminação em sistemas de recrutamento treinados predominantemente com dados de contratações masculinas. Pessoas negras são prejudicadas por algoritmos de reconhecimento facial que apresentam taxas de erro significativamente maiores para peles escuras.

Esses impactos criam ciclos viciosos. Decisões enviesadas limitam oportunidades de desenvolvimento para grupos já desfavorecidos. A falta de representação em posições de liderança perpetua a ausência dessas perspectivas no desenvolvimento de novas tecnologias, gerando ainda mais viés em sistemas futuros.

“A inteligência artificial não é neutra. Ela reflete os valores, preconceitos e limitações das pessoas e dados que a criam. Sem esforço consciente de mitigação, algoritmos amplificam desigualdades existentes em escala sem precedentes.”

Casos Documentados de Viés Algorítmico

Diversos casos de alto perfil expuseram os perigos do viés não mitigado. Um grande sistema de recrutamento foi descontinuado após descoberta de que discriminava sistematicamente candidatas mulheres. Algoritmos de precificação de seguros cobram valores mais altos de residentes de determinados bairros, perpetuando segregação socioeconômica.

No setor financeiro, estudos revelaram que sistemas de aprovação de crédito concedem limites menores a mulheres, mesmo quando seus perfis financeiros são idênticos ou superiores aos de homens. Essa discriminação automatizada afeta a vida de milhões de pessoas diariamente.

Consequências Legais e Financeiras

Empresas pagam preços elevados por viés algorítmico não endereçado. Ações judiciais coletivas resultam em acordos milionários. Reguladores impõem multas pesadas. A remediação de sistemas enviesados consome recursos significativos e desvia atenção de iniciativas estratégicas.

Contexto Regulatório: A legislação brasileira, através da LGPD, estabelece o direito de revisão de decisões automatizadas. Organizações devem garantir que seus sistemas não produzam discriminação baseada em características protegidas como raça, gênero, origem ou orientação sexual.

Estratégias de Mitigação de Viés

A mitigação efetiva de viés requer abordagem em múltiplas camadas. Organizações precisam auditar dados de treinamento para identificar desequilíbrios históricos. Equipes diversas trazem perspectivas variadas que ajudam a detectar problemas que grupos homogêneos ignorariam.

- Auditoria rigorosa de dados de treinamento

- Equipes diversas no desenvolvimento

- Testes com grupos sub-representados

- Métricas de justiça algorítmica

- Revisão humana de decisões críticas

Práticas Preventivas

- Algoritmos de debiasing pré-processamento

- Técnicas de fairness constraints

- Monitoramento contínuo de disparidades

- Análise de impacto diferencial

- Sistemas de alerta de viés

Ferramentas Técnicas

- Políticas explícitas de equidade

- Comitês de ética atuantes

- Processos de escalação de problemas

- Treinamento contínuo de equipes

- Accountability clara por resultados

Governança Organizacional

Monitoramento Contínuo e Adaptação

A mitigação de viés não é evento único, mas processo contínuo. Sistemas de inteligência artificial evoluem ao longo do tempo. Novos dados podem introduzir vieses não presentes originalmente. Mudanças no contexto social alteram o que constitui discriminação aceitável ou inaceitável.

Organizações responsáveis estabelecem programas permanentes de monitoramento. Elas acompanham métricas de justiça algorítmica, investigam anomalias e ajustam modelos conforme necessário. Essa vigilância constante é essencial para manter sistemas alinhados com valores éticos ao longo da vida útil da tecnologia.

Multas e Penalidades que Empresas Enfrentam no Mercado Global

O cenário regulatório global estabeleceu penalidades financeiras severas para violações de princípios éticos em inteligência artificial. Essas multas não são teóricas. Autoridades ao redor do mundo demonstram disposição crescente para aplicar sanções máximas contra organizações que negligenciam governança adequada.

Estrutura de Penalidades Europeias

A União Europeia estabeleceu o padrão global mais rigoroso com o AI Act. As multas podem atingir 6% da receita global anual de uma empresa ou 30 milhões de euros, prevalecendo o maior valor. Essa estrutura garante que até gigantes tecnológicos sintam impacto financeiro significativo por violações.

O escalonamento de penalidades considera a gravidade da infração. Uso de sistemas proibidos resulta nas multas máximas. Violações de requisitos para sistemas de alto risco geram penalidades de até 3% da receita global. Mesmo falhas em obrigações de transparência podem custar até 1,5% da receita anual.

Penalidades no Contexto Brasileiro

O Brasil utiliza a LGPD como base principal para penalizar uso inadequado de inteligência artificial que envolve dados pessoais. As multas podem atingir 2% do faturamento da empresa no Brasil, limitadas a R$ 50 milhões por infração. A ANPD já demonstrou disposição para aplicar essas sanções.

Setores regulados enfrentam camadas adicionais de penalidades. Instituições financeiras que utilizam inteligência artificial de forma inadequada podem receber multas do Banco Central. Empresas de saúde respondem à Anvisa e ao Ministério da Saúde. Essa sobreposição regulatória multiplica a exposição financeira.

Alerta Crítico: Empresas que operam globalmente enfrentam exposição cumulativa. Uma única violação de governança em IA pode desencadear investigações e penalidades em múltiplas jurisdições simultaneamente, multiplicando o impacto financeiro para níveis potencialmente fatais ao negócio.

Casos Reais de Penalidades Aplicadas

Grandes corporações tecnológicas já pagaram centenas de milhões em multas relacionadas a violações de privacidade e uso inadequado de dados em sistemas automatizados. Uma rede social americana foi multada em bilhões de dólares por violações que incluíam uso impróprio de informações em algoritmos de direcionamento.

No setor de recrutamento, empresas enfrentaram ações de autoridades trabalhistas por sistemas de seleção discriminatórios. Os acordos incluíram não apenas compensação financeira, mas também compromissos de auditoria independente permanente de suas ferramentas de inteligência artificial.

Penalidades Além das Multas Financeiras

O impacto regulatório vai muito além de pagamentos diretos. Autoridades podem proibir o uso de sistemas específicos, forçando organizações a abandonar investimentos de milhões de reais. Ordens de cessação de operações em mercados inteiros causam perdas incalculáveis.

| Tipo de Penalidade | Impacto Financeiro | Impacto Operacional | Duração |

| Multa Administrativa | Até 6% da receita global | Desvio de recursos para compliance | Pagamento único |

| Proibição de Sistema | Perda de investimento em desenvolvimento | Descontinuação de produtos/serviços | Permanente ou até adequação |

| Auditoria Obrigatória | Custos de consultoria externa | Redução de agilidade operacional | 1-5 anos típico |

| Restrição de Mercado | Perda de receita em jurisdições | Exclusão de oportunidades de negócio | Até remediação completa |

| Publicação de Violação | Queda no valor de ações | Dano reputacional severo | Impacto de longo prazo |

Tendências de Endurecimento Regulatório

Reguladores demonstram padrão claro de endurecimento progressivo. As primeiras violações de GDPR resultaram em advertências e multas modestas. À medida que empresas demonstraram resistência em adequar práticas, autoridades aumentaram significativamente valores de penalidades.

A mesma tendência será observada com regulações específicas de inteligência artificial. O período inicial de adaptação dará lugar a fiscalização rigorosa. Organizações que adiarem investimentos em governança enfrentarão ambiente regulatório cada vez mais hostil.

Proteja sua Organização de Multas Milionárias

Agende uma consulta estratégica de compliance em IA com nossos especialistas. Identifique vulnerabilidades críticas antes que reguladores o façam. Evite penalidades que podem representar até 6% do faturamento global.

Custos Indiretos de Não Conformidade

Além das multas diretas, empresas enfrentam custos substanciais de remediação. A reconstrução de sistemas para conformidade regulatória consome tempo e recursos. Projetos estratégicos são adiados enquanto equipes lidam com exigências de adequação emergenciais.

O custo de oportunidade é igualmente significativo. Enquanto concorrentes avançam com inovações, organizações em não conformidade dedicam energia a apagar incêndios regulatórios. Essa distração pode resultar em perda permanente de posição competitiva em mercados dinâmicos.

Perda de Confiança do Mercado como Resultado de Práticas Não Éticas

A confiança é o ativo mais valioso de qualquer organização no mundo moderno. Uma vez perdida, sua recuperação demanda anos de esforço consistente. Práticas não éticas em inteligência artificial destroem confiança com velocidade alarmante, criando danos que transcendem qualquer penalidade financeira.

Erosão da Confiança do Consumidor

Consumidores modernos possuem expectativas elevadas sobre como suas informações são utilizadas. Quando descobrem que uma empresa emprega inteligência artificial de maneira que viola seus valores ou direitos, a reação é imediata e severa. Boicotes organizados em redes sociais ganham tração em horas.

A velocidade de disseminação de informações amplifica o impacto. Um único caso de discriminação algorítmica pode se transformar em crise viral global em questão de dias. Usuários compartilham experiências negativas com suas redes, multiplicando o dano reputacional exponencialmente.

Impacto nas Relações B2B

A perda de confiança se estende ao meio corporativo. Empresas estabeleceram políticas rigorosas sobre com quem fazem negócio. Fornecedores com histórico de práticas questionáveis são excluídos de processos de seleção, independentemente de preço ou qualidade técnica.

Grandes corporações conduzem due diligence extensiva sobre governança ética de parceiros potenciais. Elas reconhecem que associação com empresas irresponsáveis cria risco reputacional transferível. Uma violação do parceiro pode contaminar a reputação de toda a cadeia de valor.

Consequências Mensuráveis

Pesquisas demonstram impactos quantificáveis da perda de confiança no desempenho financeiro de organizações:

- Queda média de 27% no valor de mercado após escândalos éticos

- Redução de 15-40% na base de clientes ativos

- Aumento de 200-500% em custos de aquisição de clientes

- Perda de 30-60% em receita de contratos corporativos

- Redução de 20-35% em capacidade de atrair talentos

Impacto no Recrutamento e Retenção

Profissionais talentosos escolhem onde trabalham baseados em valores. Cientistas de dados e engenheiros de machine learning, em particular, demonstram sensibilidade elevada a questões éticas. Eles evitam organizações com reputação questionável em governança de inteligência artificial.

A retenção de talentos existentes também sofre. Funcionários sentem vergonha de trabalhar para empresas envolvidas em escândalos éticos. A rotatividade aumenta precisamente quando a organização mais precisa de expertise para remediar problemas. Essa fuga de talentos cria ciclo vicioso difícil de reverter.

Relações com Investidores

Investidores institucionais incorporaram análise de governança ética em seus processos de avaliação. Fundos ESG, que controlam trilhões de dólares em ativos, excluem empresas com práticas questionáveis de seus portfólios. Essa exclusão limita acesso a capital e aumenta custo de financiamento.

Além disso, crises de confiança criam volatilidade significativa no valor das ações. Investidores de varejo reagem emocionalmente a manchetes negativas, provocando vendas massivas. A recuperação do valor de mercado após tais eventos é lenta e incerta.

“A confiança é conquistada em gotas e perdida em baldes. No contexto de inteligência artificial, onde decisões automatizadas afetam milhões de pessoas simultaneamente, um único erro ético pode evaporar décadas de construção reputacional.”

Ciclo de Recuperação de Confiança

A recuperação de confiança segue trajetória previsível mas dolorosa. Organizações devem primeiro reconhecer publicamente falhas, assumindo responsabilidade integral. Negação ou minimização de problemas apenas prolonga e aprofunda a crise.

Após reconhecimento, vem a fase de remediação. Empresas precisam demonstrar mudanças concretas em processos, liderança e cultura. Promessas vazias não restauram confiança. Stakeholders exigem evidências tangíveis de transformação, validadas por auditores independentes.

- Negação inicial de problemas

- Culpabilização de terceiros

- Comunicação inconsistente

- Promessas sem ações concretas

- Resistência a auditoria externa

- Foco em relações públicas vs. mudança real

Erros que Prolongam Crises

- Reconhecimento imediato e completo

- Assunção de responsabilidade clara

- Comunicação transparente contínua

- Ações corretivas rápidas e visíveis

- Convite a supervisão independente

- Demonstração de mudança cultural profunda

Práticas de Recuperação Efetiva

Prevenção como Melhor Estratégia

A construção proativa de confiança é infinitamente mais eficiente que sua recuperação pós-crise. Organizações que investem consistentemente em governança ética criam reservatórios de boa vontade que as protegem durante desafios inevitáveis.

Transparência proativa sobre como a inteligência artificial é utilizada constrói credibilidade ao longo do tempo. Empresas que compartilham informações sobre princípios éticos, processos de auditoria e até limitações de seus sistemas estabelecem relacionamento de confiança com stakeholders.

Frameworks e Práticas Recomendadas para Implementação de Governança Ética em IA

A implementação efetiva de governança ética em inteligência artificial requer estruturas robustas e práticas bem definidas. Organizações líderes desenvolveram frameworks que equilibram inovação tecnológica com responsabilidade social. Esses modelos fornecem base para desenvolvimento responsável de sistemas inteligentes.

Princípios Fundamentais de Governança

Frameworks efetivos de governança em inteligência artificial se baseiam em princípios universais que transcendem contextos específicos. Esses valores fundamentais guiam decisões em todos os níveis da organização, desde estratégia executiva até implementação técnica.

Transparência

Sistemas de inteligência artificial devem ser compreensíveis por stakeholders relevantes. Usuários precisam entender como decisões automatizadas são tomadas.

Justiça

Algoritmos devem tratar todas as pessoas de forma equitativa, sem discriminação baseada em características protegidas ou correlações injustas.

Accountability

Organizações devem assumir responsabilidade clara por sistemas que desenvolvem e implantam, com mecanismos de prestação de contas.

Privacidade

Proteção rigorosa de dados pessoais durante toda a vida dos sistemas, respeitando direitos fundamentais de usuários.

Segurança

Sistemas robustos contra ataques e falhas, com mecanismos de fail-safe para prevenir danos quando ocorrem problemas.

Beneficência

Inteligência artificial deve ser desenvolvida para beneficiar pessoas e sociedade, não apenas maximizar lucros corporativos.

Explicabilidade

Capacidade de fornecer explicações compreensíveis sobre como e por que sistemas chegaram a determinadas conclusões ou decisões.

Supervisão Humana

Manutenção de controle humano significativo sobre decisões críticas, evitando automação completa em contextos de alto impacto.

Estrutura Organizacional de Governança

A governança efetiva requer estruturas organizacionais dedicadas. Empresas líderes estabelecem comitês de ética com poder real de decisão. Esses grupos multidisciplinares incluem expertise técnica, jurídica, ética e representação de stakeholders diversos.

O comitê de ética deve reportar diretamente ao conselho de administração, não à área de tecnologia. Essa independência garante que preocupações éticas não sejam subordinadas a pressões de entrega ou métricas de performance técnica. O comitê possui autoridade para pausar ou cancelar projetos que apresentem riscos inaceitáveis.

Processo de Avaliação de Impacto Ético

Toda iniciativa de inteligência artificial deve passar por avaliação de impacto ético antes da implementação. Esse processo estruturado identifica riscos potenciais e define medidas de mitigação apropriadas. A avaliação ocorre em múltiplos estágios do ciclo de vida do projeto.

Framework de Documentação e Rastreabilidade

Documentação abrangente é essencial para accountability e conformidade regulatória. Organizações devem manter registros detalhados de decisões de design, dados utilizados, testes realizados e resultados de avaliações éticas ao longo da vida do sistema.

Prática Recomendada: Implemente “model cards” ou “datasheets” que documentam características, limitações, uso apropriado e performance de sistemas de IA. Essas fichas técnicas facilitam auditoria, revisão regulatória e tomada de decisão informada por usuários downstream.

Treinamento e Capacitação

A governança ética requer que todos na organização compreendam sua importância e suas responsabilidades. Programas de treinamento devem ser adaptados a diferentes funções, desde executivos até desenvolvedores de base.

Treinamento para Liderança

- Riscos estratégicos de IA não ética

- Frameworks regulatórios globais

- Governança e supervisão de comitês

- Casos de estudo de falhas corporativas

- Integração de ética em estratégia de negócio

Treinamento para Equipes Técnicas

- Identificação e mitigação de viés

- Técnicas de explicabilidade

- Testes de justiça algorítmica

- Privacidade por design

- Segurança em sistemas de IA

Ferramentas e Tecnologias de Suporte

Diversas ferramentas open source e comerciais auxiliam na implementação de governança ética. Bibliotecas de detecção de viés automatizam análises que seriam impraticáveis manualmente. Plataformas de explicabilidade geram justificativas para decisões de modelos complexos.

Organizações devem avaliar e adotar ferramentas apropriadas para seu contexto específico. A tecnologia facilita governança, mas não a substitui. Supervisão humana qualificada permanece essencial para interpretação de resultados e tomada de decisões em casos complexos.

Implemente Governança Ética com Metodologia Comprovada

Baixe nosso Guia Completo de Implementação de Governança Ética em IA. Metodologia passo-a-passo validada em 50+ organizações, incluindo checklists, templates e ferramentas práticas para acelerar sua jornada de compliance.

Adaptação a Contextos Específicos

Frameworks genéricos devem ser adaptados ao contexto específico de cada organização. Uma instituição financeira enfrenta riscos diferentes de uma empresa de saúde ou uma plataforma de redes sociais. O setor, jurisdições de operação e características da base de usuários influenciam a forma apropriada de governança.

A adaptação deve respeitar princípios fundamentais enquanto ajusta processos e controles. Organizações em setores altamente regulados podem precisar de processos mais rigorosos. Startups em estágios iniciais podem implementar controles proporcionais ao seu tamanho, mas sempre mantendo comprometimento com princípios éticos.

O Papel da Transparência e Accountability nos Sistemas de Inteligência Artificial

Transparência e accountability formam os pilares centrais de qualquer framework de governança ética em inteligência artificial. Esses conceitos interconectados garantem que sistemas automatizados possam ser compreendidos, questionados e, quando necessário, corrigidos por pessoas afetadas por suas decisões.

Dimensões da Transparência em IA

Transparência em inteligência artificial opera em múltiplas dimensões. Cada stakeholder necessita de níveis diferentes de informação. Usuários finais precisam entender como decisões os afetam. Reguladores exigem acesso a detalhes técnicos. Auditores independentes necessitam de documentação completa para validar conformidade.

A transparência não significa revelar segredos comerciais ou expor vulnerabilidades de segurança. Organizações podem proteger propriedade intelectual enquanto fornecem informações suficientes para accountability. O equilíbrio entre abertura e proteção legítima de informações sensíveis é desafio constante na governança de inteligência artificial.

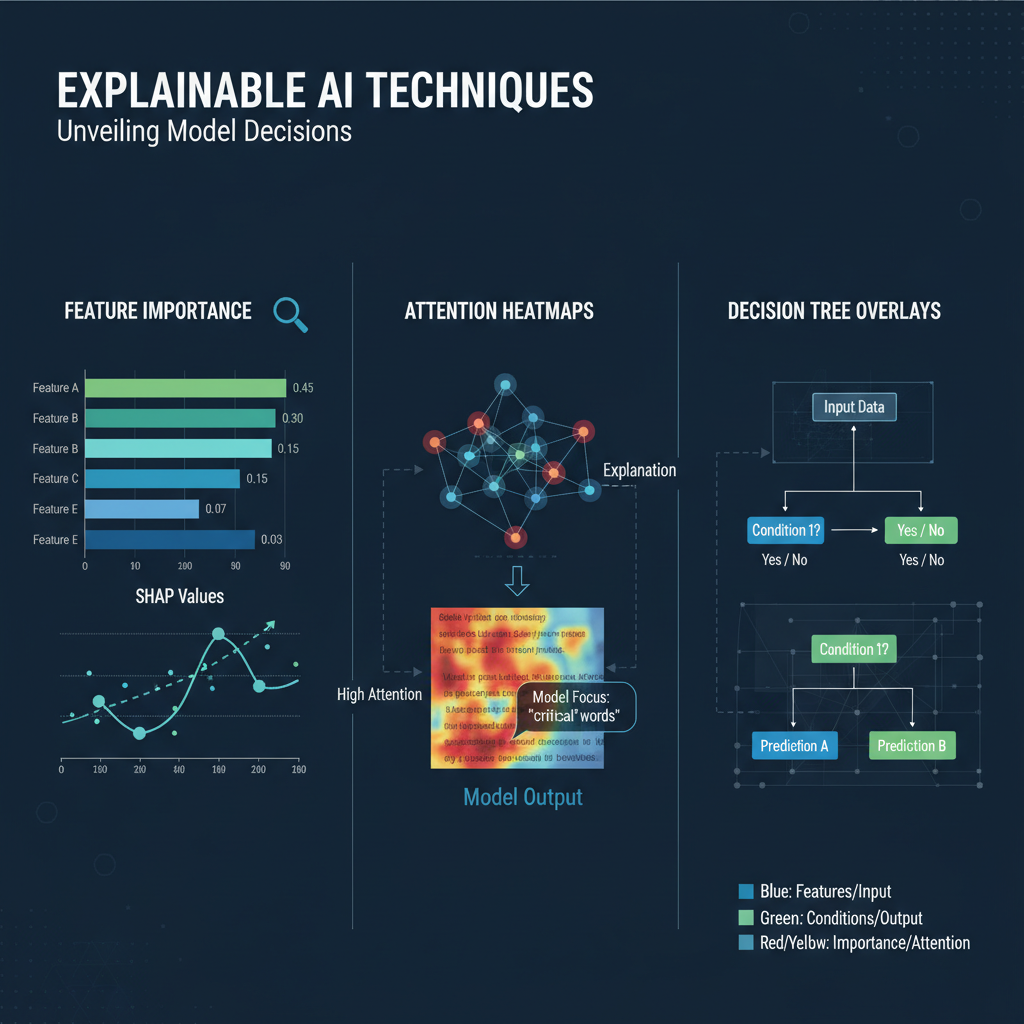

Explicabilidade Técnica vs. Compreensibilidade

Explicabilidade técnica se refere à capacidade de especialistas compreenderem funcionamento interno de sistemas. Cientistas de dados podem examinar pesos de modelos, importância de features e caminhos de decisão. Essa transparência técnica é essencial para auditoria e melhoria contínua.

Compreensibilidade, por outro lado, foca em tornar decisões inteligíveis para não especialistas. Uma pessoa negada de crédito precisa entender os motivos em linguagem clara, não jargão técnico. A tradução de complexidade algorítmica para explicações acessíveis é desafio fundamental em sistemas de inteligência artificial responsável.

Técnicas de Explicabilidade

Diversas abordagens técnicas facilitam a explicabilidade de sistemas de inteligência artificial. Cada técnica possui vantagens e limitações específicas:

- LIME (Local Interpretable Model-agnostic Explanations): Gera explicações locais aproximando modelos complexos com modelos simples interpretáveis em torno de predições específicas.

- SHAP (SHapley Additive exPlanations): Atribui valores de contribuição para cada feature baseado em teoria de jogos cooperativos, fornecendo explicações consistentes.

- Attention Mechanisms: Em modelos de deep learning, mecanismos de atenção revelam quais partes da entrada o modelo considerou mais relevantes.

- Counterfactual Explanations: Mostram quais mudanças nas características levariam a resultado diferente, ajudando usuários a entenderem o que precisariam alterar.

- Rule Extraction: Extrai regras compreensíveis de modelos complexos, criando aproximações interpretáveis de comportamento do sistema.

Accountability Organizacional

Accountability vai além de transparência técnica. Requer estruturas claras de responsabilidade quando sistemas falham ou causam danos. Organizações devem designar indivíduos específicos responsáveis por decisões de design, implementação e monitoramento de sistemas de inteligência artificial.

A cadeia de accountability deve ser documentada e comunicada claramente. Stakeholders internos e externos precisam saber a quem recorrer com preocupações. Mecanismos de escalação garantem que questões críticas alcancem níveis apropriados de liderança rapidamente.

Mecanismos de Recurso e Contestação

Sistemas responsáveis de inteligência artificial incluem processos para contestar decisões. Usuários afetados negativamente devem ter meios acessíveis de solicitar revisão humana. Esses mecanismos não podem ser meramente performativos. Devem resultar em reavaliação genuína e, quando apropriado, correção de decisões incorretas.

Requisito Legal: A LGPD brasileira garante o direito de revisão de decisões automatizadas que afetem interesses dos titulares de dados. Organizações devem implementar processos claros e eficientes para atender essas solicitações dentro de prazos regulatórios.

Auditoria Independente

Auditoria por terceiros independentes fortalece accountability. Auditores externos trazem perspectiva objetiva e expertise especializada. Eles validam alegações de conformidade e identificam vulnerabilidades que equipes internas podem ter perdido por familiaridade excessiva com sistemas.

A auditoria efetiva requer acesso abrangente a sistemas, dados e documentação. Organizações devem facilitar, não obstruir, o trabalho de auditores. Os resultados de auditorias, mesmo quando identificam problemas, demonstram comprometimento com melhoria contínua e fortalecem confiança de stakeholders.

Transparência de Dados

A qualidade e características de dados de treinamento influenciam profundamente comportamento de sistemas de inteligência artificial. Transparência sobre origem, composição e limitações de datasets é essencial para accountability. Datasheets documentam características de conjuntos de dados de maneira estruturada.

- Origem e método de coleta

- Período temporal coberto

- Demografia representada

- Vieses conhecidos ou prováveis

- Casos de uso apropriados e inapropriados

- Considerações de privacidade

Informações Essenciais sobre Dados

- Arquitetura e tipo de modelo

- Performance em grupos diversos

- Limitações e casos de falha

- Requisitos computacionais

- Considerações éticas específicas

- Instruções de uso responsável

Documentação de Modelos

- Frequência de retreinamento

- Gatilhos para revisão de modelo

- Processo de incorporação de feedback

- Versionamento e rastreabilidade

- Testes de regressão ética

- Comunicação de mudanças a usuários

Práticas de Atualização

Comunicação Proativa de Limitações

Sistemas de inteligência artificial possuem limitações inerentes. Modelos treinados em dados históricos não preveem eventos sem precedentes. Algoritmos otimizados para métricas específicas podem ter performance deficiente em cenários não considerados durante desenvolvimento. Organizações responsáveis comunicam essas limitações proativamente.

A honestidade sobre limitações constrói confiança. Usuários informados podem tomar melhores decisões sobre quando confiar em sistemas automatizados e quando buscar supervisão humana adicional. Essa transparência também protege organizações de acusações de enganar usuários sobre capacidades reais de suas ferramentas.

Cultura Organizacional de Accountability

Accountability efetiva requer cultura organizacional que valorize admissão de erros e aprendizado contínuo. Funcionários precisam sentir-se seguros para reportar problemas sem medo de retaliação. Lideranças devem recompensar transparência e penalizar encobrimento de falhas.

Essa cultura se constrói através de ações consistentes ao longo do tempo. Quando líderes assumem responsabilidade por falhas publicamente, estabelecem precedente. Quando organizações implementam mudanças em resposta a feedback crítico, demonstram que accountability não é performática, mas genuína.

Fale com Especialista em Transparência Algorítmica

Dúvidas sobre como implementar mecanismos de explicabilidade em seus sistemas? Nossa equipe de especialistas oferece orientação técnica personalizada para desafios específicos de transparência em IA.

Construindo o Futuro da Inteligência Artificial Ética

A jornada em direção a inteligência artificial verdadeiramente responsável é contínua. Não existe ponto final em que organizações possam declarar completa conformidade ética e cessar esforços. O campo evolui constantemente. Novas tecnologias criam desafios inéditos. Expectativas sociais se transformam. Regulações se adaptam.

Evolução das Práticas de Governança

As organizações líderes em governança ética não se limitam a conformidade mínima com regulações. Elas antecipam tendências, investem em pesquisa sobre práticas emergentes e participam ativamente de discussões sobre desenvolvimento de padrões globais. Essa postura proativa cria vantagem competitiva sustentável.

A governança madura integra considerações éticas em todos os estágios do ciclo de vida de produtos. Desde concepção inicial até descontinuação final, princípios responsáveis guiam decisões. Essa integração profunda é mais efetiva que adicionar camadas de compliance após desenvolvimento estar completo.

Colaboração Setorial

Nenhuma organização isolada pode resolver todos os desafios éticos da inteligência artificial. Colaboração entre empresas, mesmo concorrentes, acelera progresso. Iniciativas setoriais desenvolvem padrões compartilhados e melhores práticas. Essa cooperação beneficia todo o ecossistema.

Parcerias entre setor privado, academia e governo criam sinergias poderosas. Empresas trazem experiência prática de implementação. Universidades contribuem com rigor metodológico e perspectiva crítica. Reguladores fornecem contexto de políticas públicas e necessidades sociais mais amplas.

Investimento em Capacitação

A implementação efetiva de governança ética requer profissionais com skills especializados. Organizações precisam investir na capacitação de suas equipes. Cientistas de dados devem desenvolver expertise em justiça algorítmica. Gerentes de produto precisam entender implicações éticas de decisões de design. Executivos devem compreender riscos estratégicos de IA não ética.

Competências Técnicas Essenciais

- Detecção e mitigação de viés

- Técnicas de explicabilidade

- Privacy-preserving machine learning

- Testes de robustez e adversariais

- Auditoria algorítmica

- Segurança em sistemas de IA

Competências de Governança

- Análise de impacto ético

- Gestão de riscos de IA

- Conformidade regulatória

- Engajamento de stakeholders

- Comunicação de questões técnicas

- Tomada de decisão em dilemas éticos

Inovação Responsável

Ética e inovação não são opostos. Organizações mais inovadoras frequentemente são também as mais éticas. Princípios responsáveis estimulam criatividade ao desafiar equipes a desenvolverem soluções que respeitam valores humanos fundamentais. Essa constraint criativa resulta em produtos superiores.

Empresas que integram ética desde estágios iniciais de inovação evitam custos de refatoração posterior. Elas constroem sistemas robustos desde a fundação. Essa abordagem é mais eficiente que adicionar patches éticos em tecnologias já implantadas.

Métricas de Sucesso em Governança Ética

Organizações precisam de métricas claras para avaliar efetividade de programas de governança. Indicadores quantitativos complementam avaliações qualitativas. Essa combinação fornece visão holística de maturidade ética da organização.

Liderança pelo Exemplo

A transformação em direção a inteligência artificial responsável requer liderança forte. Executivos devem priorizar ética não apenas em discursos, mas em alocação de recursos e decisões estratégicas. Quando líderes demonstram comprometimento genuíno, esse valor permeia toda a organização.

Líderes efetivos também reconhecem que perfeição é impossível. Haverá erros e desafios inesperados. O que distingue organizações éticas não é ausência de problemas, mas como respondem quando eles ocorrem. Admissão honesta de falhas, correção rápida e aprendizado genuíno constroem credibilidade duradoura.

Auditoria Completa de Governança em IA para sua Organização

Obtenha diagnóstico 360° dos seus sistemas de inteligência artificial com roadmap personalizado de implementação. Nossa auditoria identifica vulnerabilidades críticas, avalia maturidade de governança e fornece plano de ação detalhado para conformidade e excelência ética.

Responsabilidade Compartilhada

A construção de ecossistema de inteligência artificial responsável é responsabilidade compartilhada. Desenvolvedores devem criar sistemas justos e transparentes. Empresas devem implementar governança robusta. Reguladores precisam estabelecer normas equilibradas. Usuários devem exigir práticas éticas.

Cada stakeholder possui papel importante. Academia forma próxima geração de profissionais com consciência ética. Mídia investiga e expõe práticas questionáveis. Sociedade civil advoga por direitos de grupos vulneráveis. Essa colaboração multissetorial é essencial para progresso sustentável.

Visão de Longo Prazo

A inteligência artificial transformará sociedade profundamente nas próximas décadas. As decisões que organizações tomam hoje sobre governança ética moldarão esse futuro. Investimentos em práticas responsáveis não são custos, mas investimentos na sustentabilidade de longo prazo do negócio e na criação de valor compartilhado para sociedade.

Empresas que lideram em governança ética hoje estarão bem posicionadas para prosperar no futuro. Elas terão construído confiança de usuários, relacionamentos sólidos com reguladores, equipes de alto desempenho e reputação de excelência. Esse capital intangível se traduz em vantagem competitiva duradoura.

Conclusão: Da Intenção à Ação em Governança Ética de IA

A transformação da ética de aspiração filosófica em matriz de risco corporativo fundamental representa mudança de paradigma irreversível. Organizações em todos os setores reconhecem que inteligência artificial responsável não é opcional, mas requisito essencial para operação sustentável no mercado global moderno.

Os riscos de negligenciar governança ética são claros e mensuráveis. Multas regulatórias podem atingir percentagens significativas da receita global. Perda de confiança de mercado destrói valor acumulado em décadas. Viés algorítmico não mitigado perpetua injustiças e expõe organizações a litígios custosos. Esses não são riscos teóricos. Empresas já pagam preços elevados por falhas em governança de inteligência artificial.

Ao mesmo tempo, oportunidades para organizações proativas são substanciais. Empresas que constroem reputação sólida em práticas éticas atraem talentos superiores, conquistam confiança de clientes e parceiros, e posicionam-se favoravelmente com reguladores. Essa vantagem competitiva se traduz em performance financeira superior ao longo do tempo.

A implementação efetiva de governança ética requer mais que declarações de intenção. Demanda estruturas organizacionais dedicadas, processos robustos de avaliação de impacto, investimento em capacitação de equipes e compromisso de liderança com transparência e accountability. Frameworks estabelecidos fornecem base sólida, mas devem ser adaptados ao contexto específico de cada organização.

O momento para ação é agora. Regulações globais estão sendo implementadas. Expectativas de stakeholders aumentam constantemente. Concorrentes investem em governança e ganham vantagem. Postergar investimentos em práticas responsáveis não é estratégia viável. O custo de remediação posterior excede significativamente o investimento em prevenção.

A jornada em direção a inteligência artificial verdadeiramente responsável é contínua e desafiadora. Não existe solução perfeita ou ponto de chegada definitivo. O que distingue organizações de excelência é comprometimento genuíno com melhoria constante, honestidade sobre limitações e disposição para aprender com erros inevitáveis.

Construir o futuro da inteligência artificial ética é responsabilidade compartilhada. Desenvolvedores, empresas, reguladores, academia e sociedade civil possuem papéis importantes. A colaboração entre esses stakeholders acelera progresso e garante que benefícios da tecnologia sejam distribuídos equitativamente.

Sua organização pode escolher liderar ou seguir nesta transformação. Líderes ganham vantagem competitiva, constroem reputação duradoura e moldam o desenvolvimento de padrões em seus setores. Seguidores correm atrás, remediam problemas e operam sob constante pressão regulatória. A escolha determina não apenas conformidade, mas posição estratégica de longo prazo no mercado.

A inteligência artificial possui potencial extraordinário para resolver problemas complexos e melhorar vida de bilhões de pessoas. Realizar esse potencial de maneira responsável, justa e benéfica requer vigilância constante, investimento deliberado e liderança corajosa. As ferramentas, frameworks e conhecimento estão disponíveis. A questão fundamental é vontade organizacional de priorizar ética como imperativo estratégico.

O legado que construímos hoje através de decisões sobre governança de inteligência artificial influenciará sociedade por gerações. Essa responsabilidade deve inspirar ação imediata e comprometimento duradouro com práticas que honrem dignidade humana, promovam justiça e criem valor compartilhado para todas as pessoas.