A corrida pela inteligência artificial corporativa está mudando de direção. Enquanto modelos gigantes como GPT-4 e Gemini dominaram as manchetes nos últimos anos, uma transformação silenciosa está ocorrendo nos bastidores das empresas mais inovadoras do mundo.

Modelos de Linguagem de Domínio Específico (SLMs) representam essa nova fronteira. Eles são menores, mais rápidos e surpreendentemente mais precisos para tarefas especializadas.

Em vez de depender de modelos gigantescos que tentam saber tudo sobre tudo, organizações estão descobrindo que modelos focados em seu nicho específico entregam resultados superiores. Essa mudança não é apenas tecnológica – ela está redefinindo como as empresas implementam IA de forma prática e sustentável.

Fique Atualizado sobre IA e Modelos de Linguagem

Receba insights exclusivos sobre SLMs, casos de uso reais e tendências de inteligência artificial diretamente no seu email.

O Que São Modelos de Linguagem de Domínio Específico (SLMs)

Modelos de Linguagem de Domínio Específico, conhecidos pela sigla SLMs, são sistemas de inteligência artificial treinados especificamente para domínios ou setores particulares. Diferentemente dos LLMs genéricos que processam trilhões de parâmetros de dados gerais da internet, os SLMs se concentram em conjuntos dados cuidadosamente selecionados de um campo específico.

Pense nos modelos linguagem como especialistas versus generalistas. Um médico generalista conhece muitas áreas da medicina superficialmente. Já um cardiologista possui conhecimento profundo sobre o coração e sistema cardiovascular.

Os SLMs funcionam com essa mesma lógica. Eles sacrificam amplitude de conhecimento em favor de profundidade especializada.

Características Fundamentais dos SLMs

Os SLMs se distinguem por algumas características técnicas importantes. Eles operam com um número significativamente menor de parâmetros – tipicamente entre alguns milhões a alguns bilhões, comparados aos trilhões de parâmetros dos modelos maiores.

Essa escala reduzida não é uma limitação. É uma escolha estratégica de design.

O treinamento dos SLMs utiliza dados treinamento altamente específicos do domínio-alvo. Um SLM para medicina legal seria treinado exclusivamente em literatura médica, prontuários eletrônicos, diretrizes clínicas e publicações científicas relevantes.

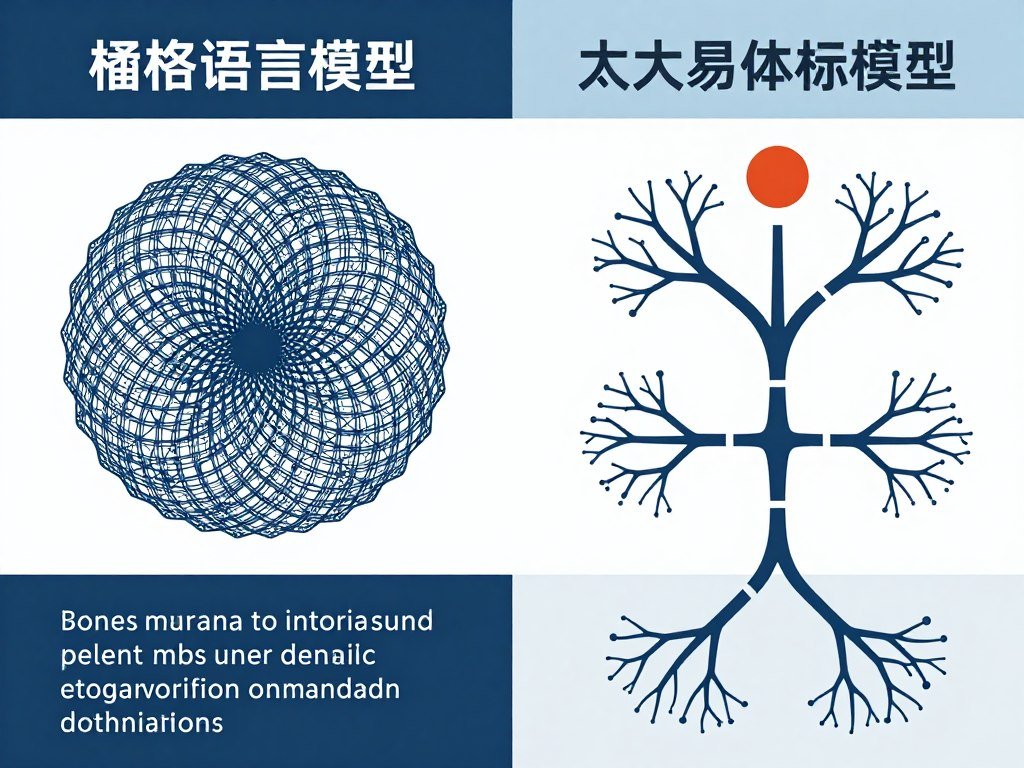

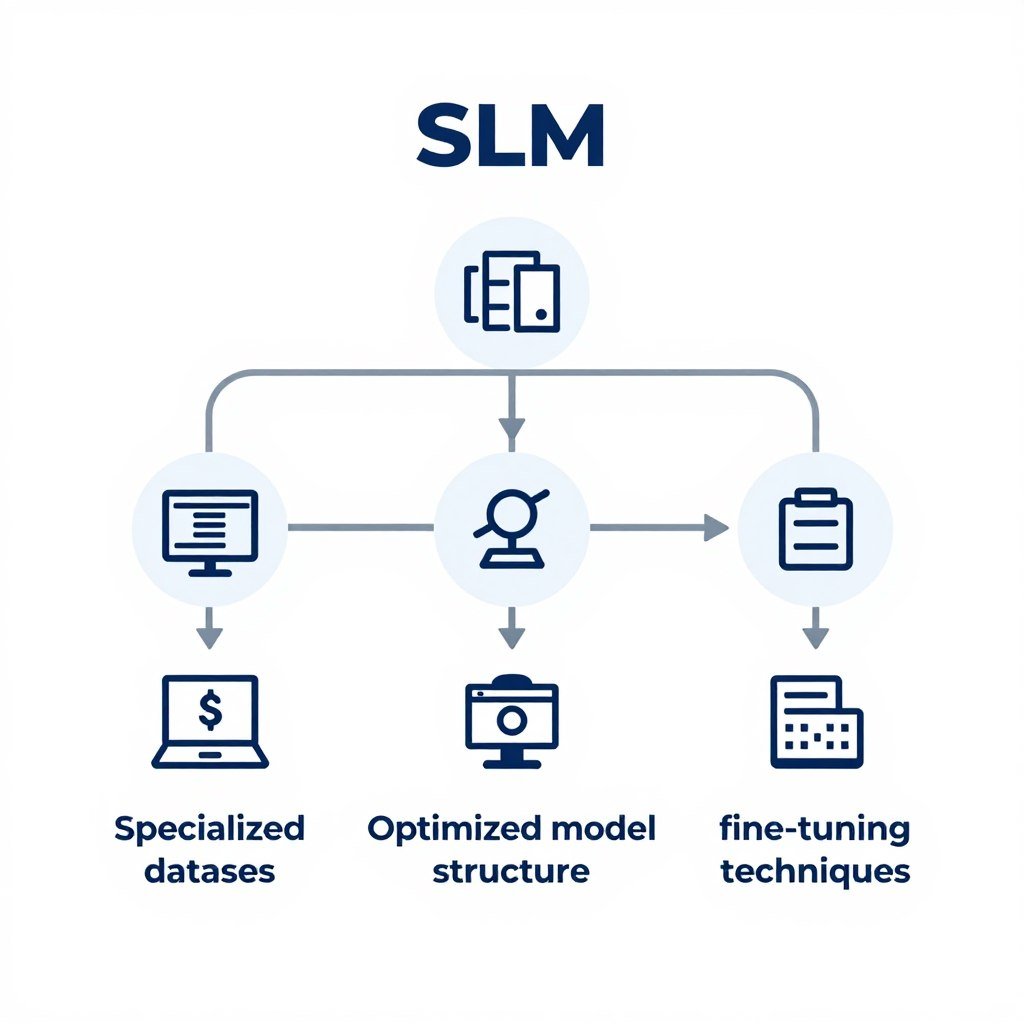

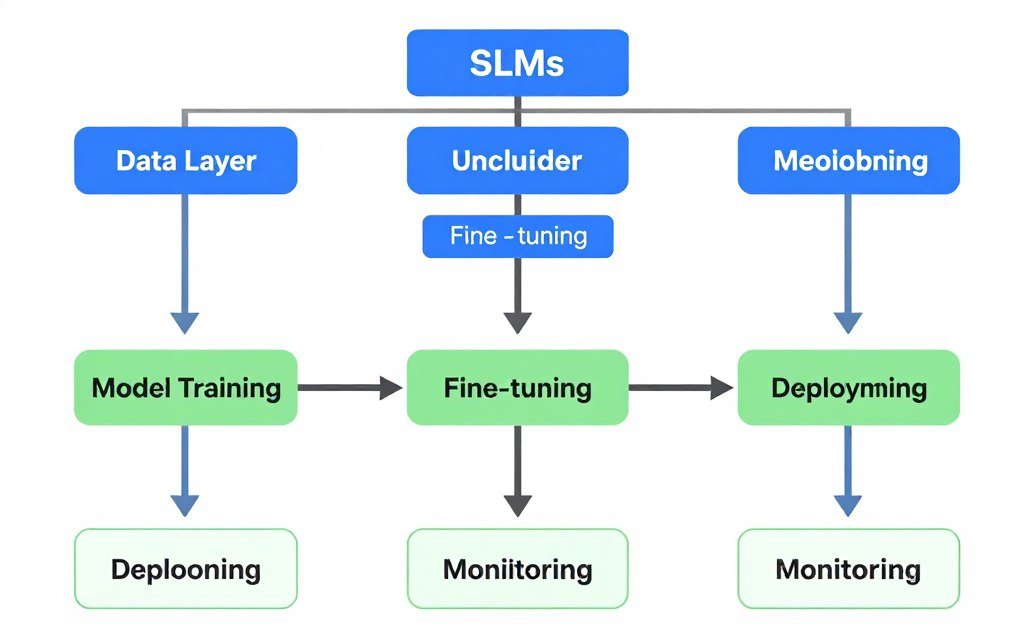

Componentes Essenciais

Os SLMs dependem de três elementos fundamentais para seu funcionamento eficaz. Primeiro, conjuntos dados especializados que capturam o vocabulário, contextos e padrões únicos do domínio.

Segundo, arquiteturas de modelo otimizadas para tarefas específicas ao invés de propósito geral. Terceiro, técnicas de ajuste fino que refinam o desempenho para casos uso particulares.

Como SLMs Diferem dos LLMs Tradicionais

A diferença entre SLMs e LLMs vai além do simples tamanho. Os modelos maiores tentam ser bons em milhares de tarefas diferentes simultaneamente. Essa versatilidade tem um custo alto em recursos computacionais e eficiência.

Os SLMs adotam abordagem oposta. Eles priorizam excelência em um conjunto limitado de tarefas específicas.

Durante treinamento, os LLMs consomem petabytes de dados da internet inteira. Os SLMs podem fazer inferência com gigabytes ou terabytes de dados altamente curados de um único domínio.

- LLMs processam conhecimento amplo mas superficial de múltiplos domínios

- SLMs desenvolvem compreensão profunda e contextual de seu nicho

- LLMs requerem infraestrutura massiva de nuvem para operação

- SLMs podem rodar em dispositivos locais com recursos limitados

- LLMs oferecem respostas genéricas que podem carecer de precisão técnica

- SLMs fornecem outputs especializados com terminologia e raciocínio específicos do domínio

Arquitetura Técnica dos SLMs

A arquitetura dos modelos linguagem especializados reflete seu propósito focado. Enquanto modelos maiores utilizam camadas densas de atenção multi-cabeça para processar contextos diversos, os SLMs podem empregar arquiteturas mais enxutas otimizadas para padrões específicos.

Muitos SLMs utilizam técnicas de compressão de modelo como quantização e poda de parâmetros. Essas abordagens reduzem o tamanho do modelo sem sacrificar significativamente o desempenho em tarefas específicas.

O ajuste fino continua sendo componente crítico. Um modelo base pode passar por múltiplas rodadas de treinamento especializado usando dados treinamento do domínio-alvo, refinando progressivamente sua capacidade de raciocínio dentro daquele contexto.

Exemplo Prático: Um SLM para análise de contratos legais pode começar com um modelo linguagem base de 7 bilhões de parâmetros. Através de ajuste fino com 50.000 contratos anotados e 200.000 precedentes legais, ele desenvolve capacidade de identificar cláusulas problemáticas com precisão superior a 95%, enquanto um LLM genérico alcançaria apenas 70-75% de acurácia na mesma tarefa.

Vantagens Competitivas dos Modelos de Linguagem de Domínio Específico (SLMs)

A migração empresarial para SLMs não é acidental. Esses modelos oferecem benefícios tangíveis que impactam diretamente o retorno sobre investimento em IA.

As vantagens vão além de simples redução de custos. Elas tocam aspectos fundamentais de desempenho, eficiência operacional e viabilidade prática de implementação.

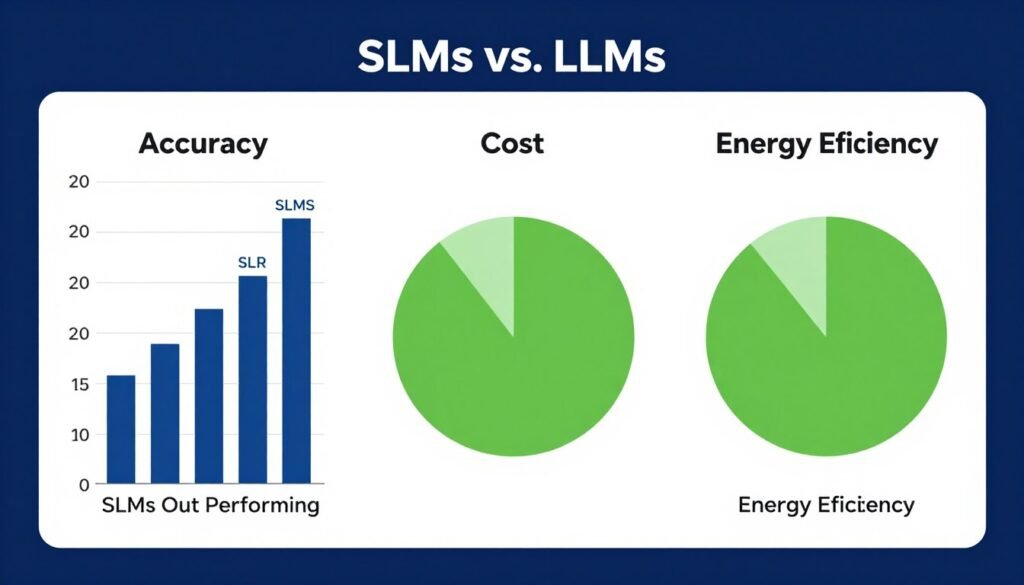

Precisão Superior em Tarefas Especializadas

A precisão representa a vantagem mais significativa dos SLMs. Quando devidamente treinados em dados treinamento de qualidade de um domínio específico, esses modelos frequentemente superam seus equivalentes genéricos por margens consideráveis.

Essa superioridade vem do foco. Os SLMs não precisam “lembrar” informações sobre culinária, esportes e história simultaneamente enquanto processam uma consulta médica complexa.

Toda sua capacidade computacional se concentra em entender nuances, terminologia e contextos específicos de seu domínio. Isso resulta em outputs mais confiáveis e profissionalmente relevantes.

4.7/5

4.6/5

4.5/5

4.4/5

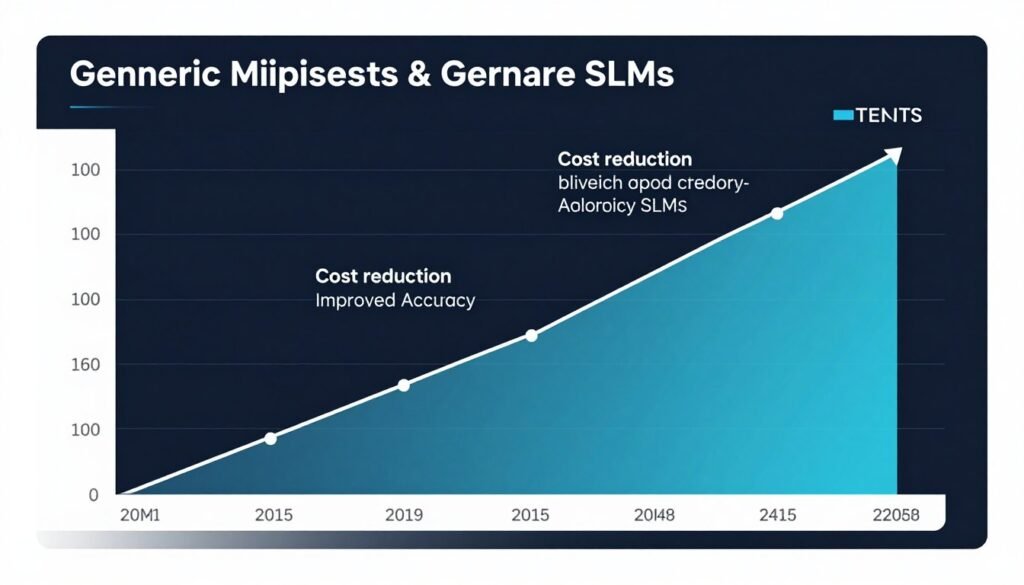

Redução Drástica de Custos Operacionais

O custo operacional dos LLMs genéricos pode ser proibitivo para muitas organizações. Cada consulta a modelos massivos requer recursos computacionais significativos, multiplicados por milhares ou milhões de requisições diárias.

Os SLMs alteram fundamentalmente essa equação econômica. Com menor número de parâmetros, eles demandam substancialmente menos poder computacional para inferência.

Essa eficiência se traduz em economia real. Empresas relatam reduções de custo entre 60% e 85% ao migrar casos uso específicos de LLMs para SLMs otimizados.

- Redução de 70-85% em custos de infraestrutura de nuvem

- Diminuição de 60-75% no tempo necessário para treinamento

- Economia de 50-65% em custos de inferência por consulta

- Menor dependência de hardware especializado caro como GPUs de última geração

- Possibilidade de execução em hardware local eliminando custos recorrentes de API

Eficiência Energética e Sustentabilidade

O consumo energético da inteligência artificial tornou-se preocupação crescente. Treinar um único modelo linguagem grande pode consumir energia equivalente ao uso de dezenas de residências por um ano inteiro.

Os SLMs oferecem alternativa substancialmente mais sustentável. Seu menor tamanho resulta em pegada energética reduzida durante tanto treinamento quanto inferência.

Essa eficiência energética não beneficia apenas o meio ambiente. Ela reduz custos operacionais e torna a IA acessível para organizações com orçamentos limitados para infraestrutura.

Impacto Ambiental LLMs

Modelos maiores podem consumir megawatts-hora de energia durante treinamento. A pegada de carbono de um único ciclo de treinamento pode equivaler a emissões de múltiplos voos transatlânticos.

Essa intensidade energética levanta questões sobre sustentabilidade de longo prazo da IA em escala massiva.

Eficiência dos SLMs

SLMs podem reduzir consumo energético em 80-95% comparado a equivalentes genéricos. Essa eficiência permite deployment em dispositivos com restrições de energia.

A redução de emissões contribui para metas corporativas de sustentabilidade enquanto mantém capacidades de IA robustas.

Baixa Latência e Velocidade de Resposta

A latência afeta diretamente a experiência do usuário em aplicações de IA. Modelos maiores frequentemente introduzem atrasos perceptíveis entre consulta e resposta, especialmente sob carga pesada.

Os SLMs oferecem baixa latência consistente. Seu tamanho compacto permite processamento mais rápido, resultando em tempo de resposta medido em milissegundos ao invés de segundos.

Essa velocidade é crítica para aplicações de atendimento cliente em tempo real, sistemas de suporte à decisão médica, e outras tarefas específicas onde cada segundo conta.

| Métrica de Desempenho | LLMs Genéricos | SLMs Especializados | Melhoria |

| Tempo de Resposta Médio | 2.5 – 4.0 segundos | 0.3 – 0.8 segundos | 75-85% mais rápido |

| Latência P95 | 5.5 segundos | 1.2 segundos | 78% redução |

| Throughput (req/seg) | 50-100 | 400-800 | 4-8x maior |

| Memória Necessária | 40-80 GB | 4-12 GB | 85-90% menor |

Implantação em Dispositivos Edge

Uma vantagem frequentemente subestimada dos SLMs é sua capacidade de rodar em dispositivos edge – smartphones, tablets, equipamentos médicos portáteis, e outros dispositivos com recursos computacionais limitados.

Essa capacidade abre possibilidades inteiramente novas para aplicações de IA. Processamento local elimina necessidade de conexão constante com nuvem, melhorando privacidade e reduzindo latência.

Em contextos médicos, por exemplo, um SLM pode rodar diretamente em um dispositivo de diagnóstico portátil, fornecendo análise instantânea sem transmitir dados sensíveis de pacientes pela internet.

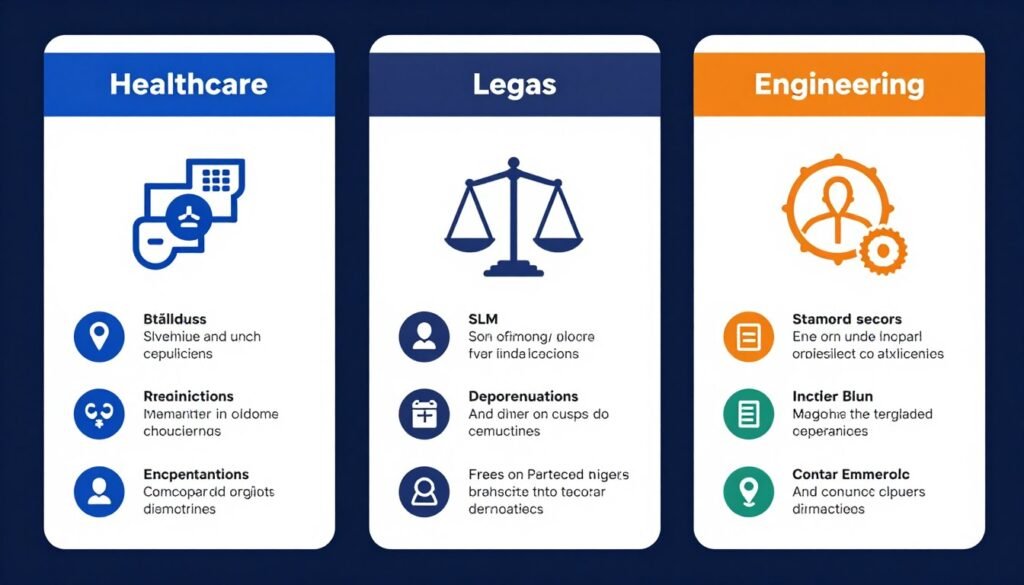

Aplicações dos Modelos de Linguagem de Domínio Específico (SLMs) por Setor

A verdadeira força dos SLMs se revela em suas aplicações práticas. Cada setor encontra casos uso únicos onde modelos especializados superam alternativas genéricas.

Vamos explorar como diferentes indústrias estão implementando SLMs para resolver desafios específicos e criar valor mensurável.

Medicina e Saúde: Precisão que Salva Vidas

O setor de saúde representa um dos domínios mais promissores para SLMs. A medicina exige precisão absoluta, e erros podem ter consequências fatais.

Modelos linguagem genéricos frequentemente falham ao lidar com terminologia médica complexa, interações medicamentosas sutis, ou protocolos clínicos específicos. Os SLMs eliminam essas limitações através de treinamento focado em literatura médica.

Hospitais e clínicas estão implementando SLMs para múltiplas tarefas específicas que melhoram tanto eficiência operacional quanto qualidade do atendimento.

Casos Uso em Saúde

- Análise automática de prontuários eletrônicos identificando padrões de risco

- Suporte à decisão clínica sugerindo diagnósticos diferenciais baseados em sintomas

- Triagem inteligente de exames de imagem com alertas para achados críticos

- Extração de dados estruturados de notas médicas não estruturadas

- Geração de resumos clínicos para transição de cuidado entre profissionais

- Identificação de interações medicamentosas perigosas em prescrições complexas

- Análise de literatura científica para suporte a protocolos de tratamento baseados em evidências

Um exemplo notável vem de um grande hospital universitário brasileiro que implementou um SLM especializado em cardiologia. O modelo foi treinado em 15 anos de registros de ECG, ecocardiogramas e prontuários cardiológicos.

O resultado superou expectativas. O SLM identificou padrões sutis de arritmia que passaram despercebidos em análise manual, reduzindo tempo de diagnóstico em 60% e melhorando taxas de detecção precoce de condições cardíacas graves.

Impacto Mensurável: A implementação de SLMs em radiologia demonstrou redução de 45% no tempo necessário para laudo de exames de rotina, permitindo que radiologistas concentrem atenção em casos complexos. A precisão diagnóstica melhorou 23% comparado a sistemas anteriores baseados em LLMs genéricos.

Direito: Velocidade e Precisão Jurídica

O campo legal é fundamentalmente baseado em linguagem. Contratos, precedentes, estatutos e decisões judiciais formam um corpus massivo de conhecimento especializado ideal para SLMs.

Escritórios de advocacia e departamentos jurídicos corporativos enfrentam volume crescente de documentos. A análise manual é cara, demorada e propensa a erro humano.

Os SLMs oferecem solução elegante. Treinados em milhares de contratos, jurisprudências e textos legais, eles podem processar documentos jurídicos com velocidade e precisão que superam revisão humana para tarefas específicas.

Aplicações Jurídicas dos SLMs

Due Diligence Automatizada

SLMs podem revisar centenas de contratos em horas, identificando cláusulas problemáticas, inconsistências e riscos potenciais. Um escritório de advocacia corporativo reduziu tempo de due diligence em fusões e aquisições de semanas para dias.

Pesquisa Jurisprudencial Inteligente

Buscar precedentes relevantes manualmente pode consumir dias de trabalho de advogados sênior. SLMs especializados em jurisprudência podem identificar casos relevantes em minutos, considerando nuances contextuais que sistemas de busca tradicionais perdem.

- Análise de contratos identificando desvios de templates padrão

- Extração automática de obrigações, prazos e condições contratuais

- Comparação de múltiplas versões de documentos destacando mudanças críticas

- Geração de resumos executivos de documentos legais complexos

- Classificação automática de correspondências por urgência e tipo

- Suporte à redação de petições com sugestões baseadas em casos similares

Um departamento jurídico de instituição financeira implementou SLM especializado em contratos de crédito. O modelo identifica automaticamente cláusulas de garantia, condições de vencimento antecipado, e requisitos regulatórios.

A economia foi substancial. O que anteriormente exigia 40 horas de trabalho de advogados juniores agora é completado em 2 horas com revisão humana focada apenas em pontos críticos identificados pelo modelo.

Engenharia: Otimização e Inovação Técnica

A engenharia abrange disciplinas diversas, cada uma com sua própria linguagem técnica, padrões e melhores práticas. SLMs especializados estão transformando fluxos trabalho em múltiplas áreas de engenharia.

Desde análise de especificações técnicas até otimização de processos de manufatura, os modelos podem processar documentação complexa e fornecer insights acionáveis.

A precisão é particularmente crítica aqui. Erros em engenharia podem resultar em falhas catastróficas de sistemas, riscos de segurança, e perdas financeiras massivas.

Engenharia Civil e Construção

A indústria de construção lida com volumes enormes de documentação – plantas, especificações, códigos de construção, manuais de segurança, e relatórios de inspeção.

SLMs treinados em dados treinamento de projetos de construção podem auxiliar em múltiplas tarefas específicas que historicamente consumiam tempo significativo de engenheiros experientes.

- Revisão automática de conformidade com códigos de construção

- Identificação de conflitos entre disciplinas em projetos BIM

- Análise de viabilidade técnica em fase de pré-projeto

- Extração de quantitativos de materiais de especificações

- Geração de cronogramas preliminares baseados em escopo de projeto

Engenharia de Software e Sistemas

Desenvolvedores de software já utilizam ferramentas baseadas em IA para geração de código. Mas SLMs especializados levam isso além, focando em domínios técnicos específicos como sistemas embarcados, aplicações financeiras, ou software médico.

Um SLM treinado em código de sistemas críticos de segurança entende não apenas sintaxe, mas também padrões de design, requisitos regulatórios, e práticas de teste específicas daquele domínio.

| Área de Engenharia | Caso Uso Principal | Métrica de Impacto | Resultado Típico |

| Engenharia Mecânica | Análise de falhas e manutenção preditiva | Redução de downtime | 35-50% menos paradas não planejadas |

| Engenharia Elétrica | Otimização de circuitos e consumo energético | Eficiência energética | 15-25% redução de consumo |

| Engenharia Química | Otimização de processos industriais | Rendimento de produção | 8-15% aumento de yield |

| Engenharia de Software | Revisão de código e detecção de bugs | Bugs em produção | 40-60% redução de incidentes |

Finanças e Serviços Bancários

O setor financeiro foi pioneiro na adoção de IA para análise de risco, detecção de fraude, e atendimento cliente. SLMs levam essas capacidades a novo patamar de precisão.

Instituições financeiras lidam com regulamentações complexas que variam por jurisdição. Um SLM treinado em legislação financeira brasileira, por exemplo, pode navegar nuances da regulamentação do Banco Central com precisão impossível para modelos genéricos.

Casos Uso Financeiros

- Análise de risco de crédito com dados alternativos e não estruturados

- Detecção de lavagem de dinheiro em transações complexas

- Atendimento cliente automatizado para consultas sobre produtos financeiros

- Geração de relatórios de conformidade regulatória

- Análise de sentimento de mercado a partir de notícias financeiras

- Suporte à decisão de investimento baseado em análise fundamentalista

Um banco regional implementou SLM especializado em análise de demonstrações financeiras de pequenas empresas. O modelo processa balanços, DREs, e fluxos de caixa, gerando scores de risco de crédito em minutos.

A precisão superou modelos anteriores baseados em regras fixas. A taxa de inadimplência em carteiras avaliadas pelo SLM caiu 28%, enquanto aprovações de crédito para bons pagadores aumentaram 15%.

Casos de Uso Reais de SLMs em Seu Setor

Baixe nosso guia completo com estudos de caso detalhados mostrando implementações bem-sucedidas de Modelos de Linguagem de Domínio Específico em medicina, direito, engenharia e finanças.

Por Que Empresas Estão Migrando de LLMs para SLMs

A mudança de modelos genéricos para especializados não é apenas tendência tecnológica. Ela reflete maturação do mercado de inteligência artificial corporativa.

Empresas que inicialmente adotaram LLMs estão descobrindo limitações práticas que SLMs resolvem de forma elegante.

Limitações dos LLMs em Ambientes Corporativos

Modelos maiores prometiam ser solução universal para todas as necessidades de IA. A realidade provou ser mais complexa.

LLMs enfrentam desafios significativos em ambientes empresariais. Primeiro, eles frequentemente “alucinam” – geram informações plausíveis mas factualmente incorretas. Em contextos críticos como medicina ou direito, isso é inaceitável.

Segundo, o custo de operação em escala pode ser proibitivo. Uma empresa processando milhões de consultas diariamente enfrenta contas de infraestrutura astronômicas.

- Falta de conhecimento profundo em domínios especializados

- Custos operacionais insustentáveis em escala

- Latência inadequada para aplicações de tempo real

- Dificuldade de controlar e auditar comportamento do modelo

- Dependência de fornecedores externos para APIs de modelo

- Preocupações com privacidade ao enviar dados sensíveis para nuvem

Vantagens Estratégicas da Especialização

SLMs oferecem controle que LLMs não podem igualar. Empresas podem treinar e ajustar fino modelos usando seus próprios dados proprietários, criando vantagem competitiva sustentável.

Esse conhecimento incorporado ao modelo torna-se ativo estratégico. Concorrentes não podem simplesmente comprar acesso ao mesmo nível de especialização via API pública.

A capacidade de deployment local também é crucial. Dados sensíveis nunca precisam deixar a infraestrutura da empresa, atendendo requisitos rigorosos de compliance e segurança.

Modelo de Implementação Tradicional (LLMs)

- Dependência de APIs de terceiros

- Custos baseados em volume de uso

- Dados enviados para servidores externos

- Controle limitado sobre comportamento

- Atualizações forçadas do fornecedor

Modelo de Implementação com SLMs

- Deployment em infraestrutura própria

- Custos previsíveis de hardware

- Processamento local de dados sensíveis

- Controle total sobre ajuste fino

- Estabilidade e governança interna

ROI Comprovado de SLMs

O retorno sobre investimento de SLMs se manifesta em múltiplas dimensões. Redução de custos é a mais óbvia, mas longe de ser a única.

Empresas relatam melhorias em eficiência operacional quando tarefas específicas são automatizadas com precisão superior. O tempo economizado de profissionais especializados pode ser redirecionado para atividades de maior valor.

Um estudo com 150 empresas que migraram casos uso de LLMs para SLMs revelou padrões consistentes de retorno.

4.6/5

4.8/5

4.2/5

4.4/5

4.7/5

Processo de Migração: Da Avaliação à Implementação

Migrar de LLMs para SLMs requer planejamento cuidadoso. Não é simplesmente trocar um modelo por outro.

O processo começa com identificação de casos uso apropriados. Nem toda aplicação se beneficia de especialização. Tarefas que requerem conhecimento amplo de múltiplos domínios podem ainda funcionar melhor com LLMs.

Para casos uso bem definidos em domínio específico, a migração segue etapas estruturadas.

Etapas da Migração

- Auditoria de Uso Atual: Mapeie todas as aplicações atuais de LLMs, identificando volume de uso, custos e métricas de desempenho.

- Identificação de Candidatos: Selecione casos uso que operam em domínio bem definido com dados treinamento disponíveis.

- Avaliação de Dados: Verifique disponibilidade e qualidade de conjuntos dados específicos do domínio para treinamento.

- Prova de Conceito: Implemente piloto limitado comparando SLM contra solução LLM existente.

- Medição de Resultados: Compare precisão, latência, custo e satisfação do usuário entre as abordagens.

- Ajuste Fino Iterativo: Refine o SLM baseado em feedback real e casos edge identificados.

- Implementação Gradual: Migre progressivamente carga de trabalho de LLM para SLM, mantendo fallback.

- Otimização Contínua: Estabeleça processos para atualização periódica com novos dados treinamento.

Um aspecto crítico frequentemente negligenciado é a qualidade dos dados treinamento. SLMs são altamente sensíveis à qualidade dos dados de domínio usados para ajuste fino.

Investir em curadoria cuidadosa de conjuntos dados resulta em diferença significativa no desempenho final do modelo.

Armadilha Comum: Empresas às vezes subestimam o esforço necessário para preparar dados treinamento de qualidade. Dados mal rotulados, enviesados, ou desatualizados produzirão SLMs de desempenho inferior. Aloque 40-50% do tempo e orçamento de projeto para preparação de dados.

Desafios e Considerações da Migração

A transição para SLMs não é isenta de desafios. Reconhecer e planejar para esses obstáculos aumenta chances de sucesso.

Primeiro, SLMs requerem expertise técnica diferente. Equipes acostumadas a simplesmente chamar APIs de LLMs precisam desenvolver capacidades em ajuste fino, avaliação de modelos, e MLOps.

Segundo, manter modelos atualizados demanda processos estabelecidos. Domínios evoluem – novas regulamentações em direito, novos tratamentos em medicina, novas tecnologias em engenharia. O SLM deve evoluir junto.

- Necessidade de construir ou adquirir expertise em treinamento de modelos

- Investimento inicial em infraestrutura para treinamento e inferência

- Tempo necessário para curar e preparar conjuntos dados de qualidade

- Estabelecimento de pipelines de MLOps para deployment e monitoramento

- Gestão de expectativas sobre escopo limitado comparado a LLMs

Avalie a Viabilidade de SLMs para Sua Empresa

Nossa equipe de especialistas pode conduzir assessment completo de suas necessidades de IA, identificando oportunidades de migração para SLMs e estimando ROI potencial.

Implementação Técnica de Modelos de Linguagem de Domínio Específico (SLMs)

Compreender os fundamentos técnicos de SLMs capacita equipes a tomar decisões informadas sobre implementação. Embora os detalhes possam ser complexos, os conceitos principais são acessíveis.

Esta seção explora aspectos técnicos práticos que profissionais precisam conhecer ao trabalhar com SLMs.

Seleção de Modelo Base

A criação de SLM tipicamente começa com modelo base pré-treinado. Em vez de treinar um modelo do zero – processo extremamente caro e demorado – organizações partem de modelos existentes e os especializam.

A escolha do modelo base impacta significativamente resultado final. Fatores a considerar incluem tamanho, arquitetura, e qualidade dos dados usados no pré-treinamento.

Modelos open-source populares para base incluem Llama, Mistral, Falcon, e BERT (para tarefas específicas). Cada um oferece tradeoffs diferentes em desempenho, tamanho e facilidade de ajuste fino.

| Modelo Base | Parâmetros | Pontos Fortes | Melhor Para |

| Llama 2 | 7B – 70B | Versatilidade, documentação extensa | Aplicações gerais de domínio |

| Mistral 7B | 7.3B | Eficiência, desempenho acima do esperado | Deployment com recursos limitados |

| Falcon | 7B – 180B | Treinamento em dados diversos de alta qualidade | Aplicações multilíngues |

| BERT | 110M – 340M | Excelente em classificação e NER | Tarefas de compreensão e classificação |

Técnicas de Ajuste Fino

O ajuste fino transforma modelo base genérico em SLM especializado. Várias técnicas existem, cada uma com características distintas de eficiência e desempenho.

A técnica mais direta é ajuste fino completo, onde todos os parâmetros do modelo são atualizados usando dados treinamento do domínio. Essa abordagem oferece máxima flexibilidade mas requer recursos computacionais substanciais.

Técnicas mais eficientes como LoRA (Low-Rank Adaptation) e QLoRA permitem ajuste fino de alta qualidade com fração dos recursos. Elas congelam a maioria dos parâmetros do modelo, atualizando apenas camadas adaptadoras menores.

Comparação de Técnicas de Ajuste Fino

Ajuste Fino Completo

Descrição: Atualiza todos os parâmetros do modelo durante treinamento.

Vantagens: Máxima flexibilidade e adaptação ao domínio.

Desvantagens: Requer GPUs potentes e tempo significativo.

Uso Ideal: Quando recursos não são limitação e máxima precisão é crítica.

LoRA / QLoRA

Descrição: Adiciona camadas adaptadoras de baixo rank treinadas enquanto modelo base permanece congelado.

Vantagens: Reduz requisitos de memória em 60-80%.

Desvantagens: Levemente inferior ao ajuste fino completo em alguns casos.

Uso Ideal: Maioria dos casos uso corporativos com recursos limitados.

Prompt Tuning

Descrição: Otimiza prompts virtuais adicionados à entrada sem modificar parâmetros do modelo.

Vantagens: Extremamente eficiente, requer mínimo treinamento.

Desvantagens: Desempenho inferior para adaptação profunda.

Uso Ideal: Adaptações rápidas ou quando múltiplos domínios compartilham um modelo.

Preparação e Curadoria de Dados

A qualidade do SLM final é diretamente proporcional à qualidade dos dados treinamento. Garbage in, garbage out permanece verdade absoluta.

Dados de domínio devem ser cuidadosamente coletados, limpos, e rotulados. Para tarefas supervisionadas, rotulação precisa é crucial e frequentemente requer expertise de profissionais do domínio.

Volume também importa, mas qualidade supera quantidade. Dez mil exemplos de alta qualidade, cuidadosamente curados, podem produzir resultados superiores a cem mil exemplos ruidosos.

Pipeline de Preparação de Dados

- Coleta: Agregar documentos, conversas, ou outros textos do domínio de múltiplas fontes.

- Limpeza: Remover duplicatas, corrigir erros de codificação, normalizar formatos.

- Filtragem: Eliminar conteúdo de baixa qualidade, irrelevante, ou problemático.

- Anotação: Rotular dados para tarefas supervisionadas usando especialistas do domínio.

- Validação: Verificar consistência e correção das anotações através de múltiplos revisores.

- Divisão: Separar dados em conjuntos de treinamento, validação e teste.

- Augmentação: Opcionalmente expandir dados através de técnicas como parafrasagem.

A divisão apropriada de dados é frequentemente negligenciada. O conjunto de teste deve representar verdadeiramente dados que o modelo encontrará em produção, não apenas uma amostra aleatória dos dados treinamento.

Regra Prática para Volume de Dados: Para ajuste fino efetivo de SLM, busque minimamente 1.000-5.000 exemplos de alta qualidade para tarefas simples, 10.000-50.000 para tarefas de complexidade média, e 50.000+ para tarefas altamente complexas com muitas nuances.

Avaliação e Métricas de Desempenho

Avaliar SLMs requer métricas apropriadas ao caso uso específico. Acurácia geral frequentemente não conta toda a história.

Para tarefas de classificação, métricas como precisão, recall, e F1-score para cada classe fornecem visão mais granular. Para geração de texto, métricas como BLEU, ROUGE, ou avaliação humana podem ser necessárias.

Importante também avaliar aspectos além de precisão técnica – latência, throughput, e robustez a entradas adversariais ou inesperadas.

Métricas Quantitativas

- Acurácia, Precisão, Recall, F1-score

- Perplexidade (para modelos de linguagem)

- BLEU, ROUGE (para tarefas de geração)

- Latência média e P95/P99

- Throughput (requisições por segundo)

Métricas Qualitativas

- Avaliação humana de outputs

- Preferência de especialistas do domínio

- Robustez a entradas adversariais

- Consistência de outputs relacionados

- Conformidade com requisitos regulatórios

Deployment e Infraestrutura

Colocar SLM em produção exige considerações de infraestrutura. A escolha entre deployment em nuvem, on-premise, ou edge depende de requisitos de latência, privacidade, e escala.

Para aplicações que demandam baixa latência e alta disponibilidade, arquitetura de deployment deve incluir load balancing, caching de resultados, e estratégias de fallback.

Containerização usando Docker e orquestração via Kubernetes tornaram-se práticas padrão, facilitando deployment consistente e escalável.

Opções de Deployment

- Escalabilidade elástica sob demanda

- Mínima manutenção de infraestrutura

- Acesso a GPUs especializadas quando necessário

- Custos recorrentes baseados em uso

- Dependência de conectividade de rede

Deployment em Nuvem

- Controle total sobre infraestrutura

- Máxima privacidade de dados

- Latência ultra-baixa para usuários locais

- Custos de capital inicial significativos

- Requer equipe para manutenção de hardware

Deployment On-Premise

- Operação offline sem conectividade

- Latência mínima absoluta

- Privacidade máxima – dados nunca saem do dispositivo

- Limitado por capacidade do dispositivo

- Desafios de atualização em dispositivos

Deployment Edge

Monitoramento e Manutenção Contínua

Deployment não é ponto final – é início de ciclo de vida operacional. SLMs em produção requerem monitoramento contínuo para detectar degradação de desempenho.

Domínios evoluem. Um SLM treinado em contratos legais de 2022 pode ter desempenho inferior em contratos de 2024 se novas cláusulas padrão emergiram. Retreinamento periódico é necessário.

Estabeleça pipelines automatizados para coletar feedback de produção, identificar casos problemáticos, e retreinar modelos com novos dados regularmente.

- Monitoramento de métricas de desempenho em tempo real

- Alertas para degradação de qualidade ou aumentos de latência

- Coleta de feedback de usuários sobre outputs problemáticos

- Análise regular de casos edge e falhas

- Retreinamento trimestral ou semestral com dados atualizados

- Testes A/B ao introduzir novas versões do modelo

Impacto dos SLMs no Futuro da Inteligência Artificial

Os Modelos de Linguagem de Domínio Específico representam mais que otimização técnica. Eles sinalizam mudança fundamental em como IA será desenvolvida e deployada.

O futuro não pertence exclusivamente a modelos gigantescos nem a modelos minúsculos. Será um ecossistema híbrido onde diferentes escalas de modelos coexistem, cada um servindo seu propósito ideal.

Democratização da IA Empresarial

SLMs democratizam acesso à inteligência artificial de qualidade. Pequenas e médias empresas que não podem arcar com custos de LLMs massivos podem treinar e operar SLMs especializados.

Essa democratização acelera inovação. Startups em nichos específicos podem construir vantagens competitivas através de SLMs proprietários treinados em seus dados únicos.

O conhecimento especializado torna-se ativo estratégico acessível, não privilégio exclusivo de gigantes tecnológicas com orçamentos ilimitados.

Tendências Emergentes em SLMs

Várias tendências estão moldando evolução dos modelos linguagem especializados. Modelos multimodais de domínio específico que processam texto, imagens, e outros tipos de dados simultaneamente estão emergindo.

Em medicina, por exemplo, SLM multimodal pode analisar relatório radiológico textual junto com a imagem correspondente, fornecendo análise mais rica.

Outra tendência é personalização extrema. Em vez de um SLM para todo setor de saúde, estamos vendo modelos ainda mais especializados – SLM para oncologia, SLM para cardiologia, SLM para radiologia.

Tendências-Chave para 2024-2026

- Modelos multimodais de domínio específico combinando texto, visão e áudio

- SLMs federados que aprendem de múltiplas organizações sem compartilhar dados brutos

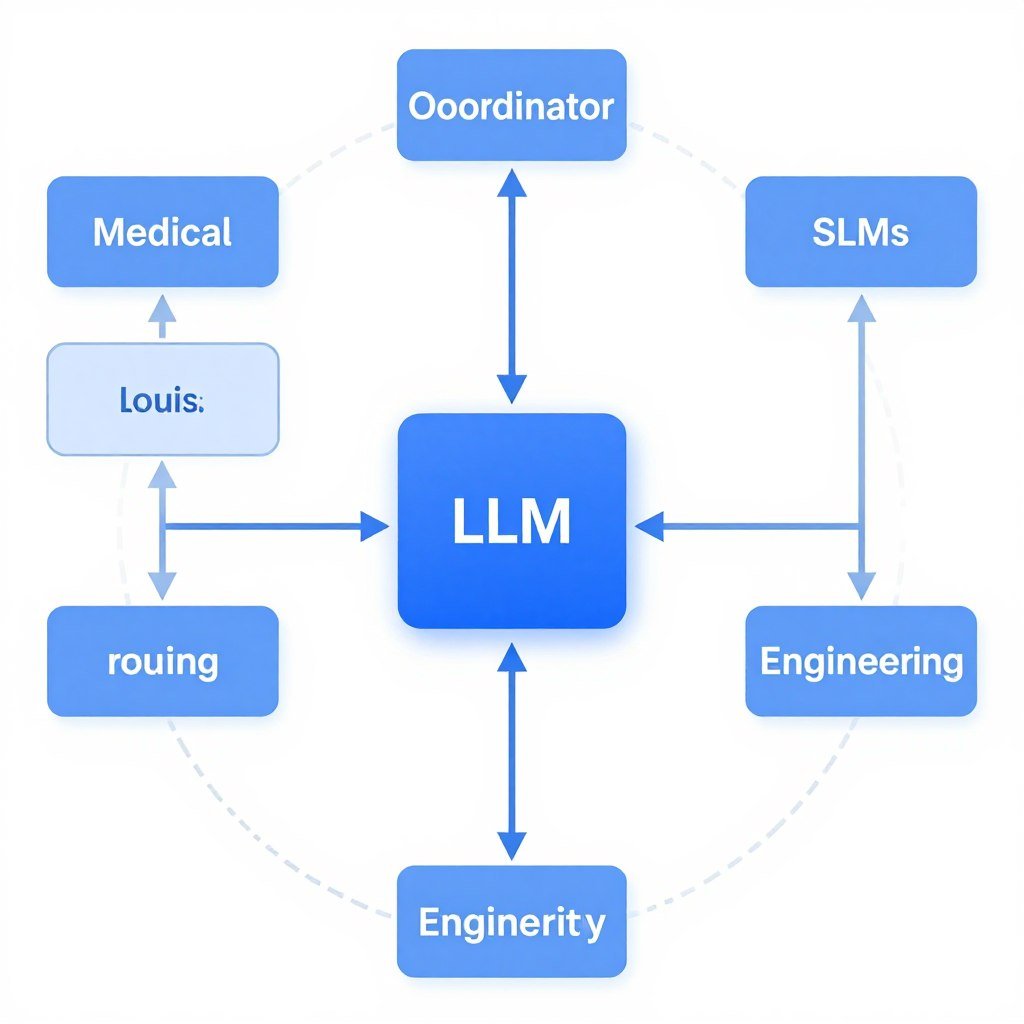

- Arquiteturas híbridas que combinam SLMs especializados com LLMs coordenadores

- Compression techniques permitindo SLMs de alta qualidade com menos de 1B parâmetros

- SLMs especializados em línguas não-inglesas e dialetos regionais

- Modelos adaptativos que ajustam automaticamente com feedback contínuo

SLMs e IA Responsável

Modelos menores oferecem vantagens significativas para IA responsável. Eles são mais interpretáveis – equipes podem auditar comportamento e identificar fontes de decisões com mais facilidade que em modelos massivos.

Viés pode ser mais controlado. Quando treinamento usa conjuntos dados cuidadosamente curados de domínio específico, é mais fácil detectar e mitigar vieses problemáticos.

A transparência também melhora. Organizações podem explicar exatamente com que dados o modelo foi treinado, atendendo requisitos crescentes de explicabilidade em setores regulados.

Regulamentação Emergente: Frameworks regulatórios como a Lei de IA da União Europeia classificam sistemas de IA por risco. SLMs deployados localmente em domínios controlados frequentemente caem em categorias de menor risco comparado a LLMs genéricos de uso amplo, simplificando conformidade.

Convergência de LLMs e SLMs

O futuro não é LLMs versus SLMs – é LLMs mais SLMs trabalhando em conjunto. Arquiteturas híbridas estão emergindo onde LLM generalista atua como coordenador, delegando tarefas especializadas para SLMs apropriados.

Imagine sistema de suporte ao cliente onde LLM identifica intenção e contexto geral da consulta, depois roteia para SLM especializado no produto específico mencionado.

Essa abordagem combina o melhor dos dois mundos – versatilidade dos modelos maiores com precisão e eficiência dos especializados.

Arquitetura de Sistema Híbrido

O LLM atua como “orquestrador inteligente”, analisando requisição de entrada e determinando qual SLM especializado deve processar a tarefa.

Múltiplos SLMs coexistem, cada um expert em seu domínio. O resultado é combinado e apresentado ao usuário de forma coerente.

Essa arquitetura otimiza custo – apenas o modelo necessário processa cada requisição, em vez de sempre invocar o LLM maior e mais caro.

Impacto no Mercado de Trabalho

SLMs estão criando novas categorias de empregos enquanto transformam existentes. A demanda por especialistas que combinam conhecimento de domínio com expertise em IA está explodindo.

Profissionais de saúde, direito, engenharia e outras áreas estão adicionando habilidades de IA aos seus repertórios. Não se trata de substituir humanos, mas de amplificar suas capacidades.

Novas funções emergem – curadores de dados de domínio, especialistas em ajuste fino de modelos, auditores de IA para setores regulados.

Novas Competências Profissionais

- Engenheiros de ML especializados em domínios específicos

- Curadores de dados que entendem tanto tecnologia quanto o domínio

- Arquitetos de soluções híbridas LLM/SLM

- Especialistas em compliance de IA para setores regulados

- Treinadores de modelo que refinam comportamento através de feedback especializado

Desafios Futuros e Oportunidades

Apesar do potencial imenso, SLMs enfrentam desafios. A fragmentação de ecossistema pode criar problemas – centenas de modelos especializados incompatíveis dificultam interoperabilidade.

Padrões industriais para treinamento, avaliação e deployment de SLMs estão apenas começando a emergir. Maior maturidade dessas práticas será crucial.

A questão da atualização contínua também permanece. Domínios evoluem, e modelos devem acompanhar. Desenvolver sistemas que aprendem continuamente sem requerer retreinamento completo é área ativa de pesquisa.

Oportunidades Futuras

- Acesso democratizado a IA especializada de qualidade

- Redução massiva de custos e impacto ambiental

- Maior precisão e confiabilidade em aplicações críticas

- Controle e transparência aprimorados

- Inovação acelerada em nichos especializados

Desafios a Superar

- Fragmentação de ecossistema e falta de padrões

- Necessidade de expertise híbrida escassa

- Esforço contínuo para manter modelos atualizados

- Desafios de integração com sistemas legados

- Gestão de múltiplos modelos especializados

Prepare Sua Organização para o Futuro da IA

Fale com nossos consultores especializados para desenvolver roadmap estratégico de implementação de SLMs alinhado aos seus objetivos de negócio. Avaliação inicial sem compromisso.

Perguntas Frequentes sobre Modelos de Linguagem de Domínio Específico (SLMs)

Organizações considerando SLMs frequentemente têm questões similares. Esta seção aborda as dúvidas mais comuns com respostas práticas baseadas em implementações reais.

Qual a diferença prática entre SLMs e LLMs para minha empresa?

A diferença principal está em precisão versus versatilidade. LLMs são generalistas que podem fazer muitas tarefas razoavelmente bem. SLMs são especialistas que fazem tarefas específicas excepcionalmente bem.

Para sua empresa, escolha depende do caso uso. Se precisa processar consultas sobre amplo range de tópicos não relacionados, LLM pode ser melhor. Se tem necessidade recorrente em domínio específico – análise de contratos legais, triagem de documentos médicos, suporte técnico para produto específico – SLM provavelmente oferecerá melhor custo-benefício e desempenho superior.

Quanto custa implementar um SLM comparado a usar APIs de LLM?

O custo varia significativamente baseado em escala de uso. Para volumes baixos (menos de 10.000 requisições mensais), APIs de LLM podem ser mais econômicas devido a baixo custo de entrada.

Para volumes médios a altos, SLMs tornam-se rapidamente mais econômicos. Investimento inicial inclui infraestrutura (GPUs para treinamento e inferência), dados treinamento, e expertise técnica – tipicamente $50.000-$200.000 para implementação inicial.

Porém, custos operacionais caem drasticamente. Uma empresa processando 1 milhão de requisições mensais pode gastar $15.000-$30.000 em APIs de LLM versus $3.000-$6.000 operando SLM próprio. ROI tipicamente ocorre entre 6-18 meses dependendo do volume.

Preciso de equipe técnica especializada para operar SLMs?

Sim, mas o nível de especialização necessário depende de sua abordagem. Três opções principais existem:

Opção 1 – Parceria com Fornecedor: Contrate empresa especializada para treinar e deployar SLM para você. Requer mínima expertise interna, mas tem custo recorrente e menor controle.

Opção 2 – Equipe Híbrida: Combine alguns especialistas internos em ML com consultoria externa para aspectos complexos. Balanço entre controle e custo.

Opção 3 – Equipe Interna Completa: Construa capacidade total internamente. Requer investimento significativo em contratação (engenheiros de ML, cientistas de dados), mas oferece máximo controle e flexibilidade.

Maioria das empresas médias tem sucesso com Opção 2, construindo capacidade gradualmente enquanto aprende com especialistas externos.

Quanto tempo leva para treinar e implementar um SLM?

Timeline típico de implementação completa varia de 2 a 6 meses, dependendo de complexidade e disponibilidade de dados. Fases incluem:

Fase 1 – Preparação (2-6 semanas): Definição de requisitos, seleção de modelo base, coleta e preparação de dados.

Fase 2 – Treinamento Inicial (1-3 semanas): Ajuste fino do modelo com dados de domínio, ajuste de hiperparâmetros.

Fase 3 – Avaliação e Refinamento (2-4 semanas): Testes rigorosos, identificação de casos edge, iterações de melhoria.

Fase 4 – Deployment (2-4 semanas): Configuração de infraestrutura, integração com sistemas existentes, deployment gradual.

Fase 5 – Monitoramento Inicial (4+ semanas): Observação de desempenho em produção, ajustes finos baseados em uso real.

SLMs podem processar múltiplos idiomas ou são limitados a inglês?

SLMs podem definitivamente processar português e outros idiomas, mas desempenho depende do modelo base escolhido e dados de treinamento disponíveis.

Para aplicações em português brasileiro, recomenda-se começar com modelo base multilíngue ou pré-treinado especificamente em português (como BERTimbau ou PTT5). Depois, ajuste fino com seus dados de domínio em português.

Desafio principal é disponibilidade de dados treinamento de qualidade. Domínios técnicos frequentemente têm menos recursos disponíveis em português que em inglês. Pode ser necessário investir em tradução profissional ou geração de dados sintéticos para suplementar conjuntos dados nativos.

Como garantir que SLM permaneça atualizado com mudanças no domínio?

Manter SLM atualizado requer processos estabelecidos de MLOps. Estratégias efetivas incluem:

Retreinamento Periódico: Agende ciclos de retreinamento trimestrais ou semestrais incorporando novos dados. Para domínios que evoluem rapidamente (como regulamentação financeira), pode ser necessário retreinamento mensal.

Aprendizado Contínuo: Implemente sistemas que coletam feedback de produção – casos onde modelo teve desempenho ruim – e os incorporam em próximo ciclo de treinamento.

Monitoramento de Drift: Estabeleça métricas para detectar quando desempenho do modelo começa a degradar devido a mudanças no domínio, disparando retreinamento proativo.

Curadoria de Dados Contínua: Mantenha equipe ou processo dedicado a identificar e curar novos dados relevantes do domínio conforme ficam disponíveis.

Quais métricas devo usar para avaliar se SLM está funcionando bem?

Métricas apropriadas dependem do caso uso específico, mas geralmente incluem três categorias:

Métricas de Qualidade: Acurácia, precisão, recall para tarefas de classificação. Para geração de texto, avaliação humana por especialistas do domínio é gold standard. Estabeleça baseline comparando contra solução anterior.

Métricas de Desempenho: Latência (tempo de resposta), throughput (requisições por segundo), disponibilidade do sistema. Defina SLAs baseados em requisitos de negócio.

Métricas de Negócio: Estas são mais importantes. Para atendimento cliente, reduziu tempo de resolução? Para análise de contratos, identificou mais riscos? Para diagnóstico médico, melhorou detecção precoce? Conecte métricas técnicas a KPIs de negócio.

SLMs podem substituir completamente especialistas humanos?

Não, e não deveriam. SLMs são ferramentas de aumento, não substituição. Eles são mais efetivos quando amplificam capacidades de especialistas humanos ao invés de tentar substituí-los completamente.

O modelo ideal é “human-in-the-loop” onde SLM processa e analisa grandes volumes de informação rapidamente, identificando padrões e casos que requerem atenção. Especialistas humanos então focam nesses casos identificados, aplicando julgamento nuanceado que IA ainda não pode replicar.

Em medicina, por exemplo, SLM pode triar 1.000 radiografias em minutos, identificando 50 que apresentam achados suspeitos. Radiologista então dedica atenção total a essas 50, confiante que casos críticos não passaram despercebidos. O resultado é melhor que humano ou máquina atuando sozinho.

Conclusão: O Papel Estratégico dos SLMs na Transformação Digital

Modelos de Linguagem de Domínio Específico representam evolução necessária da inteligência artificial corporativa. Eles trazem IA do reino de promessas genéricas para aplicações práticas e mensuráveis.

A mudança fundamental que SLMs representam não é puramente técnica. É filosófica.

Em vez de buscar modelo único que faça tudo, organizações estão reconhecendo valor de especialização. Essa especialização espelha como negócios realmente funcionam – através de expertise profunda em domínios específicos.

Principais Conclusões

Ao longo deste artigo exploramos múltiplas facetas dos SLMs. Alguns insights fundamentais emergem:

- Especialização Supera Generalização: Para tarefas específicas, modelos focados consistentemente superam equivalentes genéricos em precisão e eficiência.

- Custo-Benefício Favorável: Após investimento inicial, SLMs oferecem economia substancial em custos operacionais contínuos.

- Democratização de IA: Empresas menores agora podem acessar IA de qualidade sem orçamentos massivos.

- Sustentabilidade Importa: Menor consumo energético dos SLMs contribui para metas ambientais corporativas.

- Controle e Transparência: Deployment local e modelos menores facilitam auditoria e conformidade regulatória.

Próximos Passos para Sua Organização

Se sua organização está considerando SLMs, por onde começar? Uma abordagem estruturada maximiza chances de sucesso.

Primeiro, identifique casos uso de alto valor onde precisão de domínio é crítica. Não tente implementar SLMs para tudo simultaneamente. Escolha um ou dois casos uso piloto com ROI claro.

Segundo, avalie estado atual de seus dados. Você tem dados históricos de qualidade no domínio relevante? Se não, pode precisar investir em coleta e curadoria antes de treinar modelos.

Terceiro, determine abordagem de implementação baseada em capacidade interna. Parceria inicial com especialistas externos enquanto constrói conhecimento interno frequentemente funciona bem.

Fase 1: Descoberta

- Mapear processos que poderiam beneficiar de IA

- Identificar casos uso de alto impacto

- Avaliar disponibilidade de dados

- Estimar ROI potencial

Fase 2: Piloto

- Selecionar caso uso inicial

- Preparar conjunto de dados piloto

- Treinar e avaliar SLM

- Validar com usuários reais

Fase 3: Expansão

- Deploy em produção

- Expandir para casos uso adicionais

- Construir capacidade interna

- Estabelecer processos MLOps

O Imperativo Estratégico

IA não é mais vantagem competitiva opcional. É requisito para competir em mercados modernos. A questão não é se sua organização usará IA, mas como usará efetivamente.

SLMs oferecem caminho pragmático para capturar valor real de inteligência artificial. Eles evitam hype de modelos gigantes enquanto entregam resultados tangíveis e mensuráveis.

Organizações que adotam essa abordagem focada e especializada posicionam-se para vantagem sustentável. Seu conhecimento de domínio, combinado com IA especializada treinada em seus dados únicos, cria fosso competitivo difícil de replicar.

O futuro pertence a organizações que combinam expertise humana profunda com ferramentas de IA especializadas. Modelos de Linguagem de Domínio Específico são peça central dessa visão.

Transforme Sua Visão de IA em Realidade

Nossa equipe de especialistas está pronta para ajudar sua organização a navegar a jornada de implementação de SLMs – desde avaliação inicial até deployment em produção e otimização contínua.

Atendimento de segunda a sexta, das 9h às 18h. Primeira consultoria sem compromisso.